Tag: inférence LLM

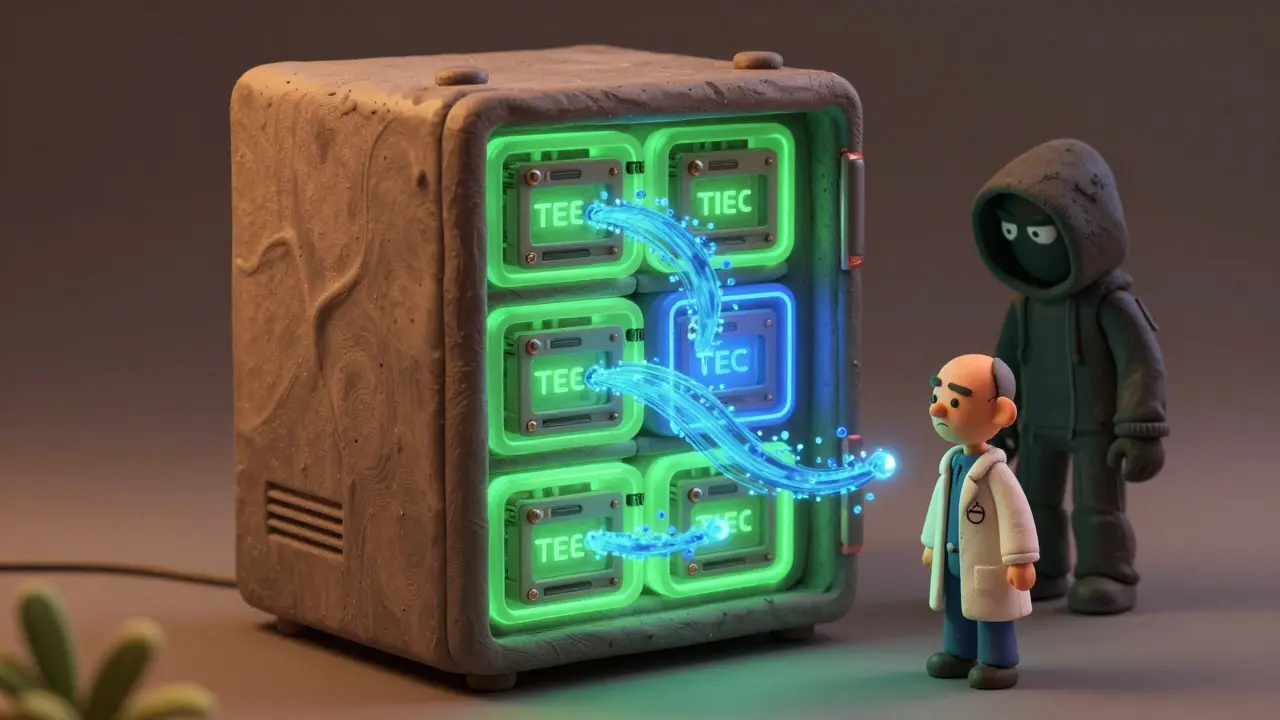

Calcul confidentiel pour l'inférence des LLM : les TEE et le chiffrement en usage

- King Willie

- |

- |

- 7

Le calcul confidentiel utilise des environnements matériels protégés pour traiter les données sensibles sans jamais les exposer. Idéal pour les LLM, il protège à la fois les modèles et les entrées des utilisateurs, avec une surcharge minimale sur les GPU NVIDIA.

Voir plusChoisir sa GPU pour l'inférence LLM : A100 vs H100 vs offloading CPU

- King Willie

- |

- |

- 6

Découvrez pourquoi le NVIDIA H100 domine l'inférence LLM en 2025, comment il compare à l'A100 et pourquoi l'offloading CPU est une mauvaise solution pour la production. Choisissez la bonne GPU pour vos modèles de langage.

Voir plus