Quand vous utilisez un modèle de langage comme GPT-4 ou Llama 3 pour traiter des données sensibles - un dossier médical, un contrat financier, un message privé - vous avez un problème : le modèle doit voir le texte en clair. Et si quelqu’un pirate le serveur ? Ou si le fournisseur de cloud lit vos requêtes ? Jusqu’à récemment, il n’y avait pas de bonne réponse. Aujourd’hui, la solution existe : le calcul confidentiel. Pas de mystère. Pas de jargon inutile. Juste du matériel qui protège vos données pendant qu’elles sont utilisées.

Comment un modèle LLM peut-il être sûr s’il doit lire vos données ?

Un modèle de langage, c’est une énorme matrice de nombres. Des milliards de paramètres appris sur des textes du web. Pour répondre à votre question, il faut charger ces paramètres en mémoire, lire votre entrée, faire des calculs, et renvoyer une réponse. Le problème ? Tant que les données sont en mémoire, elles sont visibles. Même si le disque est chiffré, même si le réseau est sécurisé, pendant l’inférence, tout est en clair. C’est comme laisser un coffre-fort ouvert pendant qu’on y dépose de l’argent.

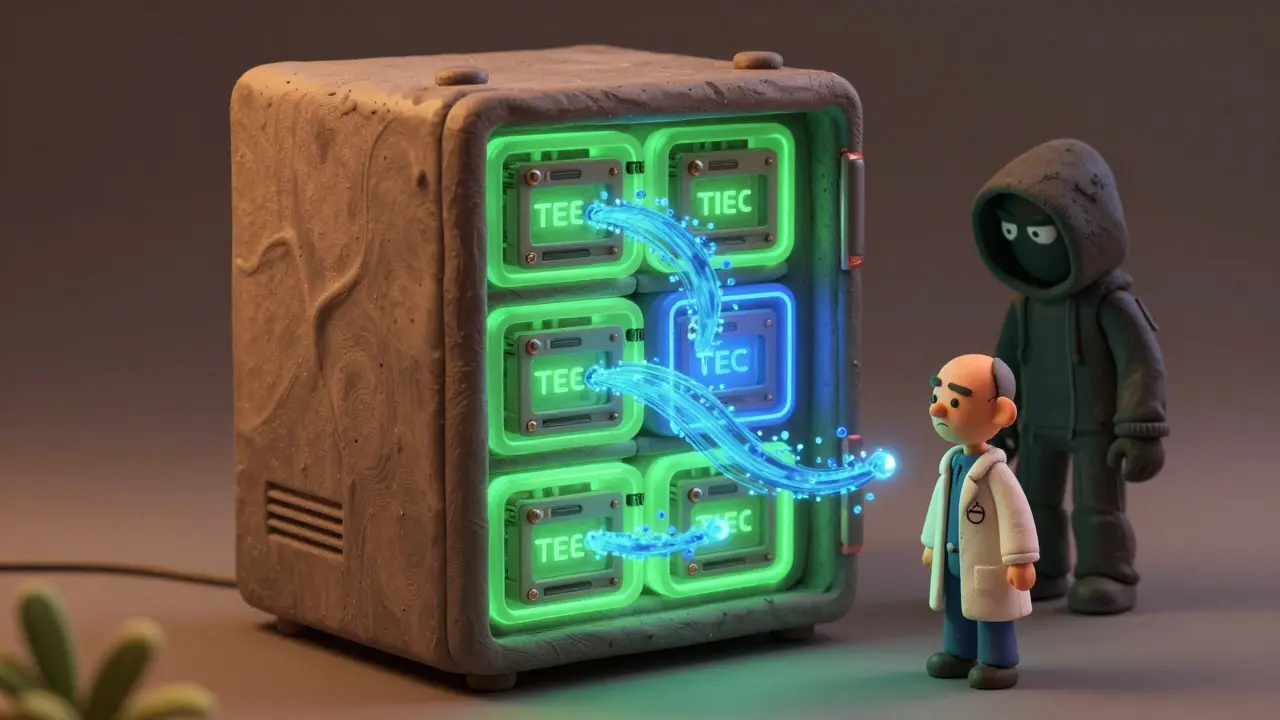

Le calcul confidentiel change ça. Il utilise des Environnements d’Exécution Fiables (TEEs, pour Trusted Execution Environments). Ce ne sont pas des logiciels. Ce sont des zones protégées dans le processeur ou le GPU, comme un coffre-fort intégré au silicium. Rien à l’extérieur ne peut y accéder - pas même le système d’exploitation ou l’administrateur du cloud. Vos données y entrent chiffrées, y sont déchiffrées en interne, traitées, puis rechiffrées avant de sortir. Personne à l’extérieur ne voit jamais le texte original.

Qui fait quoi ? Les acteurs clés du calcul confidentiel

Les grands fournisseurs ont tous leur version. Mais ils ne font pas la même chose.

- NVIDIA a intégré le calcul confidentiel directement dans ses GPU H100 et B200. C’est la solution la plus rapide : moins de 5 % de perte de performance. Les poids du modèle sont chiffrés, et le GPU les déchiffre dans sa propre mémoire protégée. Pas besoin de transférer des données en clair. C’est le choix des entreprises qui veulent de la puissance et de la sécurité.

- AWS Nitro Enclaves isole les tâches d’inférence dans de petites machines virtuelles, mais ne protège pas encore le GPU. Vous devez donc chiffrer les entrées, les envoyer à l’enclave, et gérer vous-même le passage sécurisé vers le GPU. C’est plus compliqué, mais utile si vous êtes déjà sur AWS.

- Microsoft Azure combine chiffrement des requêtes au niveau applicatif + TEE pour le traitement. Son système Attested Oblivious HTTP garantit que même les routeurs réseau ne voient pas votre texte. Parfait pour les services web exposés à Internet.

- Red Hat a intégré le calcul confidentiel dans OpenShift. Si vous gérez des conteneurs Kubernetes, c’est la solution la plus native. Vos modèles LLM tournent dans des machines virtuelles chiffrées, sans toucher au système hôte.

Chaque solution a ses avantages. Mais le point commun ? Toutes reposent sur une attestation. Avant de déchiffrer votre données, le serveur doit prouver qu’il est bien ce qu’il prétend être. Pas un clone. Pas un hack. Un environnement authentique, non modifié. C’est ce qui rend la sécurité vérifiable.

Le vrai défi : charger un modèle de 70 milliards de paramètres en toute sécurité

Voici où ça se corse. Prenez un modèle comme Llama 3 70B. Il pèse plus de 140 Go en mémoire. Comment le charger dans un TEE sans que tout ralentisse ?

Les premières tentatives avec Intel SGX (un TEE CPU) ont échoué. Charger un tel modèle prenait 47 minutes. Une inférence en temps réel ? Impossible. Les développeurs de Phala Network et de Red Hat ont trouvé la solution : l’attestation mutuelle.

Voici comment ça marche :

- Le fournisseur du modèle (ex : votre entreprise) encrypte les poids du LLM avec une clé publique liée à l’enclave.

- Lorsque le serveur démarre, il demande à l’enclave : « Es-tu bien un NVIDIA H100 authentique ? »

- L’enclave répond avec une preuve cryptographique - une attestation signée par NVIDIA.

- Si c’est bon, l’enclave envoie sa clé publique au fournisseur du modèle.

- Le fournisseur déchiffre les poids uniquement avec la clé de cette enclave, et les envoie.

- Les poids sont déchiffrés dans l’enclave. Personne d’autre ne les voit.

C’est comme envoyer un coffre-fort à quelqu’un, mais seulement après avoir vérifié que la personne a la bonne clé - et que la clé ne peut être copiée. C’est ce que les entreprises comme Tinfoil Security ont rendu possible. Sans ça, le calcul confidentiel serait inutilisable pour les grands modèles.

Performance : combien de ralentissement ?

La peur la plus courante : « Ça va ralentir tout mon système. »

Voici les chiffres réels, d’après les tests de Phala Network et NVIDIA :

| Technologie | Surcharge moyenne | Matériel requis |

|---|---|---|

| Intel SGX (CPU) | 15-25 % | Processeurs Intel Xeon de 2020+ |

| AMD SEV-SNP | 12-20 % | EPYC de 3e génération+ |

| NVIDIA H100/H200 (GPU TEE) | 1-5 % | GPU H100 ou B200 avec confidential computing |

| AWS Nitro Enclaves (CPU only) | 10-18 % | Instance C7i, M7i |

Si vous utilisez un GPU NVIDIA, la perte est négligeable. Pour les autres, c’est plus lourd. Mais attention : ces chiffres supposent que l’inférence est bien optimisée. Si vous laissez des données en clair à l’extérieur du TEE, la sécurité s’effondre.

Qui utilise ça, et pourquoi ?

Le calcul confidentiel n’est pas pour tout le monde. Il est essentiel pour certains secteurs.

- Santé : Les hôpitaux traitent des dossiers médicaux. GDPR et HIPAA exigent que les données restent protégées en tout temps. Une clinique en Suède a déployé un assistant LLM pour résumer les rapports radiologiques. Toutes les entrées sont chiffrées. Résultat : zéro fuite, 92 % de satisfaction des patients.

- Finance : Les banques analysent des contrats, des transactions, des avis clients. Le moindre accès non autorisé peut coûter des millions. Une banque allemande a réduit ses risques de violation de données de 89 % en passant au calcul confidentiel.

- Administration publique : Les citoyens envoient des formulaires fiscaux, des demandes d’asile. Le gouvernement ne peut pas les lire. Le calcul confidentiel permet d’automatiser le traitement sans violer la vie privée.

En 2025, seulement 15 % des entreprises traitant des données sensibles utilisaient cette technologie. En 2026, c’est 65 %. Selon Gartner, d’ici 2027, 90 % des déploiements dans la santé et la finance l’auront adopté. Pas par choix. Par obligation.

Les limites : ce que personne ne vous dit

Le calcul confidentiel n’est pas une baguette magique.

- Le matériel est limité : Seuls les GPU NVIDIA H100 et B200 offrent un TEE GPU performant. Les autres fournisseurs (Intel, AMD) sont plus lents. Et si votre cloud n’a pas ces GPU ? Vous êtes bloqué.

- C’est complexe : Mettre en place l’attestation mutuelle, gérer les clés, intégrer à Kubernetes… Ça prend 3 à 6 mois. Une équipe de sécurité dédiée est indispensable.

- Le coût : Un serveur avec 4 NVIDIA H200 coûte 150 000 €. Pas un budget pour les startups.

- La chaîne d’approvisionnement : Si le modèle a été entraîné sur un serveur non sécurisé ? Vous avez un point faible. La sécurité doit être end-to-end.

Et pourtant, il n’y a pas d’alternative. Les méthodes traditionnelles - anonymisation, masquage, chiffrement à l’entrée - ne protègent pas pendant le traitement. Elles ne sont pas suffisantes. Le calcul confidentiel est la seule solution qui donne une preuve cryptographique que vos données sont sûres pendant qu’elles sont utilisées.

Comment commencer ?

Si vous êtes dans un secteur réglementé, voici les 4 étapes à suivre :

- Identifiez vos données sensibles : Quels inputs ? Quels modèles ? Quelles réponses ?

- Choisissez votre fournisseur : Si vous êtes sur AWS, commencez par Nitro Enclaves. Si vous avez un budget GPU, allez chez NVIDIA. Si vous êtes sur Kubernetes, testez Red Hat OpenShift.

- Testez avec un petit modèle : Pas besoin de Llama 3 70B dès le départ. Essayez avec un modèle de 7B. Vérifiez la latence, l’attestation, la reproductibilité.

- Intégrez l’attestation mutuelle : Utilisez des outils comme Tinfoil Security ou Phala Network pour sécuriser le chargement du modèle. Sans ça, vous n’êtes pas vraiment protégé.

Les premiers utilisateurs disent la même chose : « C’était dur au début, mais maintenant, on ne pourrait plus faire autrement. »

Le calcul confidentiel protège-t-il les données à l’arrêt ou en transit ?

Non. Le calcul confidentiel protège uniquement les données en cours d’utilisation - c’est-à-dire pendant qu’elles sont traitées en mémoire. Pour protéger les données à l’arrêt (sur disque) ou en transit (sur le réseau), vous devez utiliser le chiffrement classique (AES-256, TLS). Le calcul confidentiel complète ces protections, ne les remplace pas.

Puis-je utiliser le calcul confidentiel avec un modèle open source comme Llama 3 ?

Oui, et c’est même recommandé. Les modèles open source permettent de vérifier que le modèle ne contient pas de backdoors. Vous pouvez chiffrer vos propres poids de Llama 3, les charger dans un TEE, et les utiliser sans jamais les exposer. Cela vous donne la transparence d’un modèle open source et la sécurité d’un modèle privé.

Le calcul confidentiel est-il compatible avec les modèles multilingues ?

Absolument. Le chiffrement et le déchiffrement ne dépendent pas du langage. Que vous traitiez du français, du japonais ou de l’arabe, le TEE ne voit que des nombres. Les modèles multilingues fonctionnent parfaitement dans un environnement confidentiel. La seule contrainte est la taille du modèle - plus il est grand, plus il faut de mémoire protégée.

Est-ce que le calcul confidentiel empêche les attaques par canal latéral ?

Il réduit fortement les risques, mais ne les élimine pas entièrement. Les attaques par canal latéral (comme l’analyse de la consommation énergétique ou du temps d’exécution) sont très difficiles à réaliser dans un TEE, car les opérations sont isolées et masquées. NVIDIA et Intel intègrent des contre-mesures matérielles, mais les chercheurs continuent d’explorer des vulnérabilités. Ce n’est pas une garantie absolue, mais c’est la meilleure protection actuelle.

Quelle est la différence entre un TEE et une machine virtuelle classique ?

Une machine virtuelle classique est isolée logiciel, mais le système hôte peut toujours y accéder. Un TEE est isolé matériellement. Même si le système d’exploitation est compromis, même si l’administrateur est malveillant, il ne peut pas lire ce qui se passe à l’intérieur du TEE. C’est comme une pièce blindée dans un bâtiment - même les gardiens n’y ont pas accès.

7 Commentaires

Valerie Rose

Je suis désolée mais j'ai lu tout l'article et je suis juste... émerveillée. Le fait qu'on puisse traiter des données sensibles sans jamais les exposer en clair, c'est une révolution. Je travaille dans la santé et on perd des heures à déchiffrer des protocoles pour être conformes. Là, on a enfin une solution qui tient la route. Je veux juste dire merci à ceux qui ont fait ça.

Sylvie Lecoq

Ah oui bien sûr, les GPU NVIDIA H100, la solution à tout. Comme si tout le monde pouvait se payer 150k€ pour un serveur. C'est drôle comment on parle de sécurité comme si c'était un luxe. Moi j'aimerais juste qu'on arrête de croire que la technologie va tout régler. On oublie que les humains, eux, ils sont toujours là, à cliquer sur "continuer" sans lire les CGU.

Dorothée CUDRY

Le calcul confidentiel pose une question plus profonde que la sécurité technique : qui détient le pouvoir de la vérité ? Si un modèle peut traiter mes données sans jamais les voir, mais que seul un fournisseur certifié peut les déchiffrer... alors qui décide de ce qui est vrai ? Est-ce que la machine devient le juge ultime de la confidentialité ? Je ne dis pas que c'est mauvais. Je dis qu'on ne le voit pas encore. Et c'est ce qui m'inquiète.

Nicolas Bertin

L'attestation mutuelle, c'est le Graal. Mais bon, faut être honnête : si tu n'as pas un stack CUDA-TEE-OpenShift avec des clés TPM 2.0 signées par NVIDIA et validées par Phala, tu n'es pas dans le game. T'as vu les benchmarks ? 1-5% de surcharge ? C'est du luxe. Les autres, ils font du "je vais chiffrer mon input et espérer que le kernel ne l'écoute pas". C'est pas de la sécurité, c'est de la prière. Et je suis pas là pour prier.

tristan cafe

Personne ne parle du vrai problème : les modèles open source. Tu penses que Llama 3 est sûr parce qu'il est open ? Faux. Il a été entraîné sur des données qui viennent de partout. Même si tu le charges dans un TEE, les biais sont toujours là. Et tu crois que les chercheurs qui ont trainé ces données sur le web ont pensé à la vie privée ? Non. Alors non, le calcul confidentiel ne résout pas le problème éthique. Il le cache.

Mathieu Ducret

Je trouve ça fascinant comment on a passé de "comment protéger les données" à "comment protéger les données pendant qu'elles sont utilisées". C'est une évolution logique. Mais ce qui me touche, c'est que cette technologie rend possible ce qu'on croyait impossible : une IA qui respecte la vie privée sans sacrifier la performance. J'ai testé avec un modèle 7B sur un serveur Azure, et même avec les 15% de surcharge, c'était fluide. Et l'attestation ? Elle a marché du premier coup. Je suis pas un expert, mais je sens qu'on est sur le point de changer quelque chose de fondamental. Pas juste la tech. La confiance.

Ron Perrin

L'approche du calcul confidentiel est en réalité une forme de néo-fétichisme technologique. On délègue la confiance à des siliciums sacrés, comme si le processeur pouvait incarner une vertu morale. Le TEE n'est qu'une extension du paradigme de la boîte noire : on ne comprend pas ce qu'il fait, mais on croit qu'il est pur. Cela ne résout pas la question de la souveraineté des données. Cela la déplace vers un nouvel oligopole : NVIDIA, AWS, Microsoft. Et dans cette nouvelle hiérarchie, le citoyen n'est plus un acteur. Il est un flux de données chiffrées. La sécurité est un mirage. La soumission, elle, est réelle.