Tag: hallucinations LLM

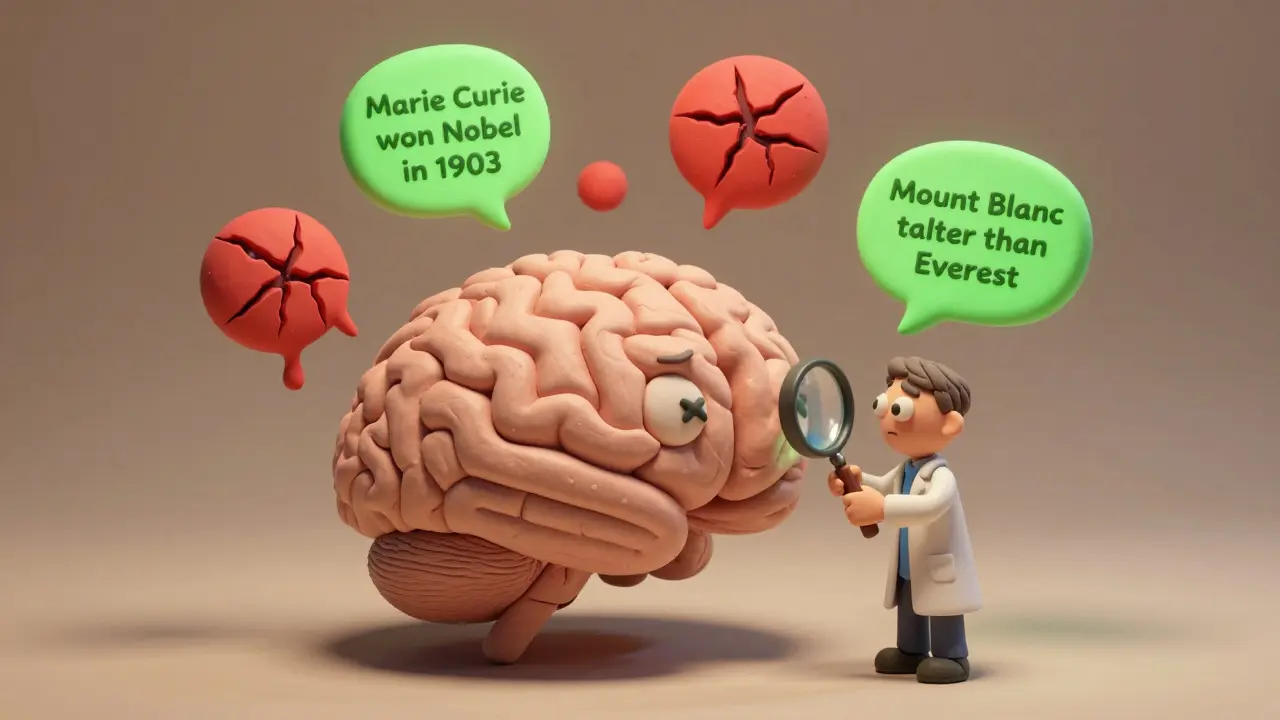

Évaluer la fiabilité des LLM : génération ancrée et pipelines de vérification factuelle

- King Willie

- |

- |

- 10

Évaluer la fiabilité des modèles de langage est devenu essentiel pour éviter la diffusion de fausses informations. Découvrez les méthodes, indicateurs et outils clés pour mesurer et améliorer la vérité des réponses générées par les LLM en 2026.

Voir plusTemplates de prompts pour réduire les hallucinations des LLM sur les données d'entreprise

- King Willie

- |

- |

- 7

Les templates de prompts structurés réduisent jusqu'à 89 % les hallucinations des LLM sur les données d'entreprise. Découvrez les 5 éléments clés, les pièges à éviter et les meilleures pratiques pour rendre l'IA fiable dans vos processus métier.

Voir plusMesurer le taux d'hallucinations dans les systèmes LLM en production : métriques et tableaux de bord

- King Willie

- |

- |

- 0

Apprenez à mesurer et à contrôler les hallucinations des modèles de langage en production grâce aux métriques fiables, aux tableaux de bord et aux meilleures pratiques de 2025. Réduisez les risques et protégez votre réputation.

Voir plus