Quand une entreprise utilise un modèle linguistique massif (LLM) pour traiter des données sensibles - comme des dossiers médicaux, des communications privées ou des secrets commerciaux - elle ne contrôle plus seulement son propre système. Elle dépend aussi de fournisseurs externes : des prestataires cloud, des équipes de développement tiers, des services d’analyse de données, ou même des consultants qui ont accès à ces modèles. Et là, le risque ne vient plus seulement d’un piratage interne. Il vient de ceux qu’elle n’a pas directement sous contrôle.

pourquoi les fournisseurs sont le point faible le plus critique

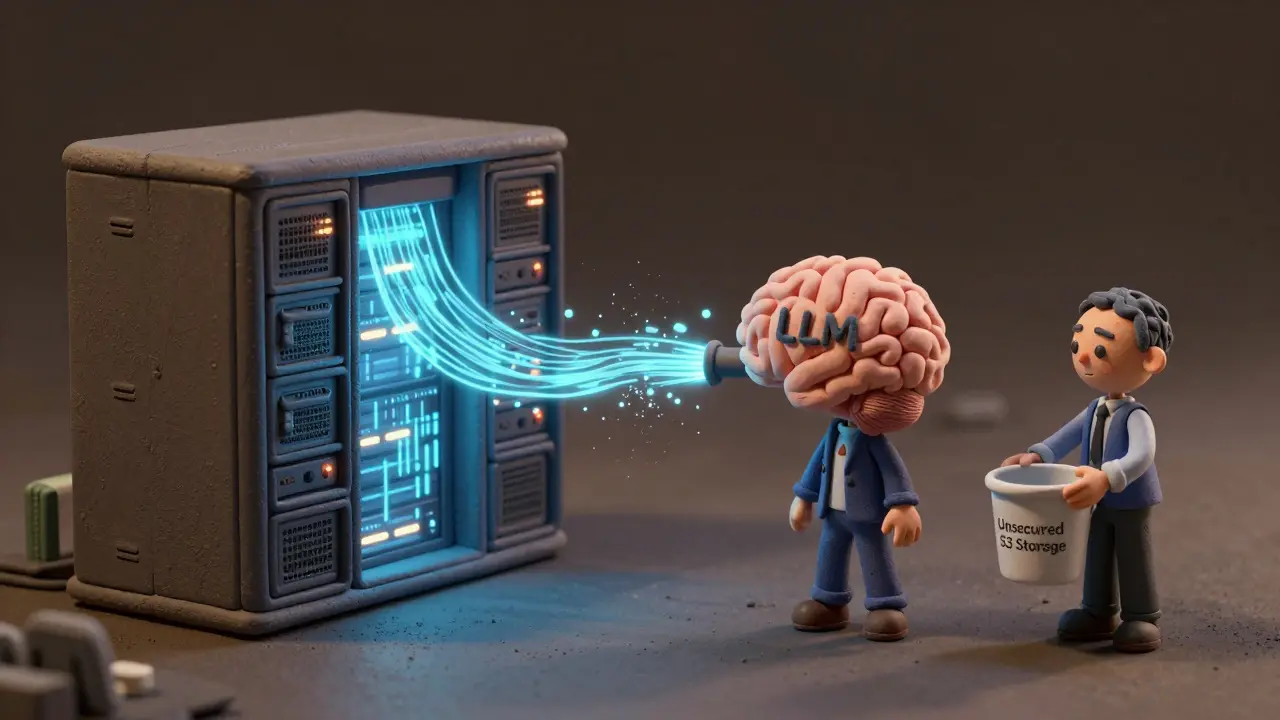

> Plus de 60 % des violations de données en 2025 ont été déclenchées par un fournisseur tiers, selon une étude de l’Institut européen de cybersécurité. Les LLM ne sont pas des boîtes noires. Ils apprennent à partir de données. Et quand ces données sont partagées avec un fournisseur - même pour une simple amélioration de la qualité des réponses - elles deviennent une cible. Un fournisseur mal sécurisé peut exposer des données confidentielles, permettre une injection de prompts malveillants, ou même détourner les modèles pour créer des réponses falsifiées. Ce n’est pas une hypothèse théorique. En 2024, une plateforme de service client utilisant un LLM a été compromise parce qu’un partenaire externe avait stocké des extraits de conversations dans un bucket S3 non protégé. Des milliers de dossiers clients ont été exposés.quels sont les risques spécifiques liés aux données LLM ?

Les risques classiques de gestion des tiers - fuites de données, non-conformité, défaillance technique - existent, mais les LLM en ajoutent de nouveaux, plus subtiles :- Exfiltration de données d’entraînement : Un fournisseur peut reconstituer des données sensibles à partir des réponses du modèle, même si les données originales ont été supprimées.

- Injection de prompts malveillants : Un accès mal contrôlé permet à un tiers de manipuler les réponses du modèle pour diffuser des informations fausses ou biaisées.

- Poisoning du modèle : Si un fournisseur a accès à la phase de fine-tuning, il peut injecter des données biaisées ou malveillantes pour altérer le comportement du modèle à long terme.

- Reconstruction de données : Même avec des données anonymisées, certains modèles peuvent générer des informations réelles à partir de motifs appris - ce qu’on appelle l’inversion de modèle.

Ces risques ne sont pas couverts par les contrôles classiques de sécurité informatique. Un simple audit de conformité PCI ou ISO 27001 ne suffit pas. Il faut une approche ciblée.

comment évaluer un fournisseur qui gère des données LLM ?

Voici les 5 critères que toute entreprise doit exiger avant de partager des données LLM avec un tiers :- Accès limité et isolé : Le fournisseur ne doit pas avoir accès à l’ensemble du modèle ou de ses données. Utilisez des environnements isolés (sandbox) et des API avec contrôle d’accès granulaire.

- Chiffrement des données en transit et au repos : Les données doivent être chiffrées avant d’être envoyées au fournisseur. Aucun accès en clair ne doit être permis.

- Absence de stockage persistant : Le fournisseur doit garantir qu’aucune donnée d’entrée ou de sortie n’est enregistrée sur ses serveurs après traitement. Les logs doivent être effacés en temps réel.

- Validation des pratiques de fine-tuning : Si le fournisseur améliore le modèle, il doit fournir des preuves que les données d’entraînement sont synthétiques ou entièrement anonymisées. Aucune donnée réelle ne doit être utilisée sans consentement explicite.

- Transparence sur les sous-traitants : Le fournisseur doit déclarer tous ses propres partenaires. Un fournisseur de cloud utilisé par votre fournisseur est aussi un risque.

les outils qui changent la donne en 2026

Les plateformes de gestion des risques tiers ont évolué. Elles ne se contentent plus de poser des questions. Elles analysent activement les risques.Par exemple, Safe Security est une plateforme qui utilise des modèles linguistiques pour analyser les réponses aux questionnaires de sécurité des fournisseurs. Il détecte automatiquement les formulations vagues comme « nous avons des contrôles » ou « nous suivons les meilleures pratiques » et les signale comme des alertes.

Vanta propose un système d’évaluation des risques inhérents qui attribue un score automatique aux fournisseurs en fonction du type de données qu’ils traitent. Un fournisseur qui manipule des données LLM reçoit un score de risque élevé par défaut.

Mitratech permet de mapper les exigences spécifiques aux LLM sur des cadres comme NIST CSF ou ISO 27001, en ajoutant des contrôles dédiés : « vérification de l’absence de stockage », « audit des mécanismes de suppression des données », etc.

Le secret ? Ces outils ne se contentent pas de vérifier des documents. Ils analysent les comportements en temps réel. Ils surveillent les changements dans les politiques de sécurité du fournisseur, les nouvelles vulnérabilités publiques sur ses systèmes, ou même les alertes de sécurité sur les réseaux sociaux.

les contrats doivent changer, pas seulement les processus

Un contrat standard ne suffit plus. Voici ce que chaque accord avec un fournisseur de LLM doit inclure :- Une clause d’interdiction de stockage des données d’entrée/sortie.

- Une obligation de suppression immédiate après traitement (avec preuve écrite).

- Une restriction explicite sur l’utilisation des données pour l’entraînement de nouveaux modèles.

- Un droit d’audit en temps réel sur les systèmes de traitement.

- Une responsabilité financière claire en cas de fuite liée à la gestion des données LLM.

En 2025, une entreprise de santé a perdu un litige parce que son contrat ne mentionnait pas l’interdiction de réutilisation des données. Le fournisseur avait utilisé des conversations anonymisées pour améliorer un modèle concurrent. Résultat : des millions d’euros d’amende, et une perte de confiance durable.

comment commencer, même sans budget massif ?

Vous n’avez pas besoin d’un système sophistiqué pour débuter. Voici un plan simple en 3 étapes :- Identifiez tous les fournisseurs qui touchent à vos données LLM : même les petits prestataires de traduction ou de modération de contenu.

- Créez une liste de 5 exigences minimales (chiffrement, pas de stockage, pas de fine-tuning, audit, suppression) et demandez une déclaration écrite de conformité.

- Utilisez un outil gratuit comme Vanta ou Kroll pour automatiser la découverte des risques. Ils offrent des versions gratuites avec surveillance de base.

Le but n’est pas d’être parfait. C’est d’être conscient. Chaque fournisseur qui traite vos données LLM est une porte ouverte. Et la plupart des entreprises ne regardent même pas derrière.

ce qui se passe si vous n’agissez pas

Les régulateurs commencent à cibler les risques LLM. En janvier 2026, l’Autorité européenne de protection des données a publié des lignes directrices spécifiques : tout partage de données avec un tiers pour entraîner ou améliorer un LLM doit être déclaré comme un traitement à haut risque. Sans évaluation formelle, vous risquez des amendes jusqu’à 4 % de votre chiffre d’affaires mondial - comme pour un non-respect du RGPD.Et ce n’est pas seulement une question légale. Votre réputation est en jeu. Les clients savent maintenant que les modèles linguistiques peuvent être manipulés. S’ils apprennent que vous partagez leurs données avec un fournisseur non vérifié, ils partiront. Et ils ne reviendront pas.

Quels sont les fournisseurs les plus à risque lorsqu’ils traitent des données LLM ?

Les fournisseurs les plus à risque sont ceux qui ont accès à la phase de fine-tuning, ceux qui stockent les données en clair, ou ceux qui utilisent vos données pour améliorer leurs propres modèles. Les petits prestataires de modération de contenu, les services de traduction automatisée, et les plateformes cloud non sécurisées sont souvent les plus négligés - et les plus dangereux.

Puis-je utiliser un fournisseur qui ne respecte pas toutes mes exigences ?

Oui, mais seulement si vous réduisez l’exposition. Par exemple, si un fournisseur ne peut pas garantir la suppression des données, vous pouvez lui envoyer uniquement des données synthétiques ou des échantillons anonymisés. Ne partagez jamais des données réelles avec un partenaire qui ne respecte pas vos exigences de base. Le risque n’en vaut jamais la peine.

Le RGPD couvre-t-il les risques liés aux LLM avec des fournisseurs tiers ?

Oui, et même plus. Le RGPD considère que l’entraînement ou l’amélioration d’un LLM avec des données personnelles est un traitement à haut risque. Vous devez effectuer une évaluation d’impact, obtenir un consentement explicite, et imposer des clauses contractuelles strictes à vos fournisseurs. Ignorer cela, c’est violer le RGPD.

Comment savoir si un fournisseur a déjà été compromis ?

Utilisez des outils comme Kroll CyberClarity360 ou Safe Security qui surveillent en continu les vulnérabilités publiques, les fuites de données sur le Dark Web, et les alertes de sécurité des fournisseurs. Vous pouvez aussi consulter les rapports de l’Autorité européenne de protection des données, qui publie régulièrement des listes de fournisseurs sanctionnés pour non-respect de la sécurité des données.

Est-ce que les modèles open source sont plus sûrs pour les fournisseurs ?

Pas nécessairement. Les modèles open source sont souvent moins sécurisés parce qu’ils manquent de supervision. Un fournisseur qui utilise un modèle open source sans audit de sécurité peut introduire des vulnérabilités cachées. Le fait qu’un modèle soit open source ne signifie pas qu’il est sûr. Ce qui compte, c’est comment il est utilisé, mis à jour et protégé.

9 Commentaires

Emeline Louap

Je suis tombé sur cet article en cherchant des infos pour notre fournisseur de modération de contenu, et j’ai failli avoir une crise d’angoisse. On pensait qu’on était safe parce qu’on utilisait juste un API pour filtrer les commentaires, mais non. On a découvert qu’ils stockaient les logs pendant 30 jours pour ‘améliorer la qualité’. 30 JOURS. J’ai demandé des preuves de suppression, ils ont répondu ‘on le fait, mais on ne le note pas’. C’est quoi ce bordel ? J’ai l’impression qu’on est dans une série dystopique où tout le monde fait semblant de respecter les règles pour pas avoir l’air mauvais, mais personne ne les applique vraiment. On a coupé le contrat hier. Je vous dirai si on a trouvé un vrai partenaire, parce que franchement, c’est le Far West du LLM aujourd’hui.

Emilie Arnoux

oui mais bon j’ai testé vanta en gratuit et c’est juste magique 😍 j’ai scané 3 fournisseurs et 2 étaient à risque élevé sans qu’on s’en rende compte. genre un truc de traduction qu’on utilisait depuis 2 ans. j’ai cru qu’il y avait un bug, non, c’était vrai. ils avaient un bucket S3 ouvert. j’ai juste hurlé dans mon bureau. merci pour l’article, j’ai tout partagé à mon boss et il a compris (pour une fois).

Vincent Lun

Vous êtes tous des paranoïaques. On parle de modèles linguistiques, pas de missiles nucléaires. Si un fournisseur stocke des données, c’est pour améliorer le service. Vous voulez tout chiffrer, tout isoler, tout auditer ? C’est possible, mais ça coûte une blinde. Et qui va payer ? Les clients ? Vous croyez que les entreprises vont se ruiner pour un ‘risque théorique’ ? Moi je préfère un bon service fiable qu’un capharnaüm de contrôles qui ralentissent tout. La sécurité, c’est important, mais pas au point de tuer l’innovation.

Pierre Dilimadi

Je viens du Sénégal, et ici on utilise beaucoup de LLM pour traduire les documents médicaux. On n’a pas de budget pour Safe Security ou Vanta. Mais on a fait simple : on envoie seulement des phrases anonymes, pas de noms, pas de dates. On a demandé au fournisseur de jurer sur la Bible qu’il ne garde rien. Il a ri, mais il a signé. On n’est pas parfaits, mais on fait ce qu’on peut. Parfois, la simplicité sauve plus que les outils chers.

Stéphane Evrard

Je me demande si on ne confond pas sécurité et contrôle. On a peur des fournisseurs parce qu’on ne les comprend pas. On les voit comme des entités étrangères, des ‘autres’ qui pourraient nous voler nos données. Mais qu’est-ce qui nous empêche de les intégrer dans notre écosystème ? Et si on les formait à notre culture de la confidentialité ? Et si on les rendait partenaires plutôt que suspects ? Peut-être que la vraie solution, ce n’est pas de verrouiller tout, mais d’apprendre à faire confiance… intelligemment. La technologie n’est pas le problème. C’est notre peur de l’autre qui nous fait créer des murs.

James Swinson

J’ai lu l’article en entier, et je dois dire que ça m’a fait réfléchir. J’ai travaillé dans une startup qui utilisait un fournisseur pour modérer les commentaires des utilisateurs. On avait un contrat ‘standard’. On a découvert après coup qu’ils utilisaient nos données pour entraîner leur propre modèle de chatbot. On n’a rien vu venir. Aujourd’hui, on a mis en place les 5 exigences du post, et ça a changé tout. Pas besoin d’outils coûteux : un bon questionnaire, un appel avec le fournisseur, et une vérification mensuelle. Ce qui compte, c’est la vigilance. Et surtout, ne laissez jamais quelqu’un dire ‘on a toujours fait comme ça’. Le ‘toujours’ est un piège. La sécurité, c’est un processus, pas un état. Faites-le simple, faites-le régulier, et vous serez déjà ahead de 80 % des entreprises.

Magaly Guardado-Marti

Vous êtes tous des amateurs. J’ai travaillé chez une banque qui a été piratée via un fournisseur de cloud. On a perdu 12 millions. Et vous parlez de Vanta comme si c’était la solution divine ? Faux. Le vrai problème, c’est que personne ne veut payer pour la sécurité. Tout le monde veut le ‘gratuit’ ou le ‘rapide’. Les régulateurs vont bientôt frapper fort, et vous allez voir. Les PDG vont être emprisonnés. Les startups vont faire faillite. Et vous, vous allez dire ‘mais on ne savait pas’. Ben non, vous saviez. Vous avez lu cet article. Vous avez vu les exemples. Et vous avez continué. Vous êtes des crétins. Et vous méritez ce qui va venir.

Lucile Dubé

OH MON DIEU. J’AI VU UN BUCKET S3 OUVERT SUR MON PROJET. J’AI CRÉÉ UN POST SUR LINKEDIN ET ÇA A VIRALISÉ. MAIS PERSONNE NE ME CROIT. J’AI TÉLÉPHONÉ À L’HÉBERGEUR ET IL A RÉPONDU ‘C’ÉTAIT UN ERREUR, ON L’A CORRIGÉ’. J’AI DEMANDÉ DES PREUVES. IL A RÉPONDU ‘ON NE GARDE PAS LES LOGS’. J’AI RI. J’AI PLEURÉ. J’AI DÉPOSÉ UNE PLAINE. J’AI ÉCRIT UN LIVRE. J’AI DÉMÉNAGÉ. J’AI CHANGÉ DE MÉTIER. MAIS J’AI TOUT PARTAGÉ ICI PARCE QUE JE VEUX QUE TOUS SACHENT. VOUS N’AVEZ AUCUNE IDÉE DE CE QUE C’EST D’ÊTRE VICTIME. VOUS PENSEZ QUE C’EST UN ARTICLE. C’EST UNE VIE. J’AI PERDU MON SOMMEIL. MON TRAVAIL. MON AMOUR. MAIS JE SUIS ENCORE LÀ. ET JE NE ME TAIS PAS.

Rene Pérez Vázquez

Quelle naïveté. Vous parlez de ‘5 exigences’ comme si c’était une liste de courses. Le vrai problème, c’est que personne ne lit les contrats. Personne ne comprend les termes techniques. Et encore moins les audits. Vous croyez que Vanta va sauver le monde ? C’est juste un outil qui fait des jolis graphiques pour les managers qui ne veulent pas lire un seul mot du RGPD. Et les ‘modèles open source’ ? Ah oui, bien sûr, ‘open source’ = ‘sûr’. Comme si le code libre était un sacre. J’ai vu des modèles open source avec des backdoors intégrés par des contributeurs anonymes. Et vous, vous allez les déployer en production sans audit ? Bravo. Vous êtes les nouveaux ‘je n’ai pas lu les CGU’ de la cybersécurité. La seule chose qui sauvera l’industrie, c’est un retour à l’humilité. Et à la lecture. Mais bon, je doute que quelqu’un ici ait fini un paragraphe sans faire un selfie.