Vous avez déjà entendu parler de GPT-4 ou de Llama 3 ? Ces modèles sont puissants, mais ils consomment autant d’électricité qu’une petite ville. Et pourtant, vous utilisez peut-être déjà une version plus légère de ces modèles sans le savoir - comme ChatGPT-3.5 Turbo. Comment est-ce possible ? La réponse réside dans une technique appelée distillation de modèles. Elle permet de créer des modèles d’IA beaucoup plus petits, qui fonctionnent presque aussi bien que leurs géants, mais avec 80 % moins de ressources.

Comment ça marche ? Le professeur et l’élève

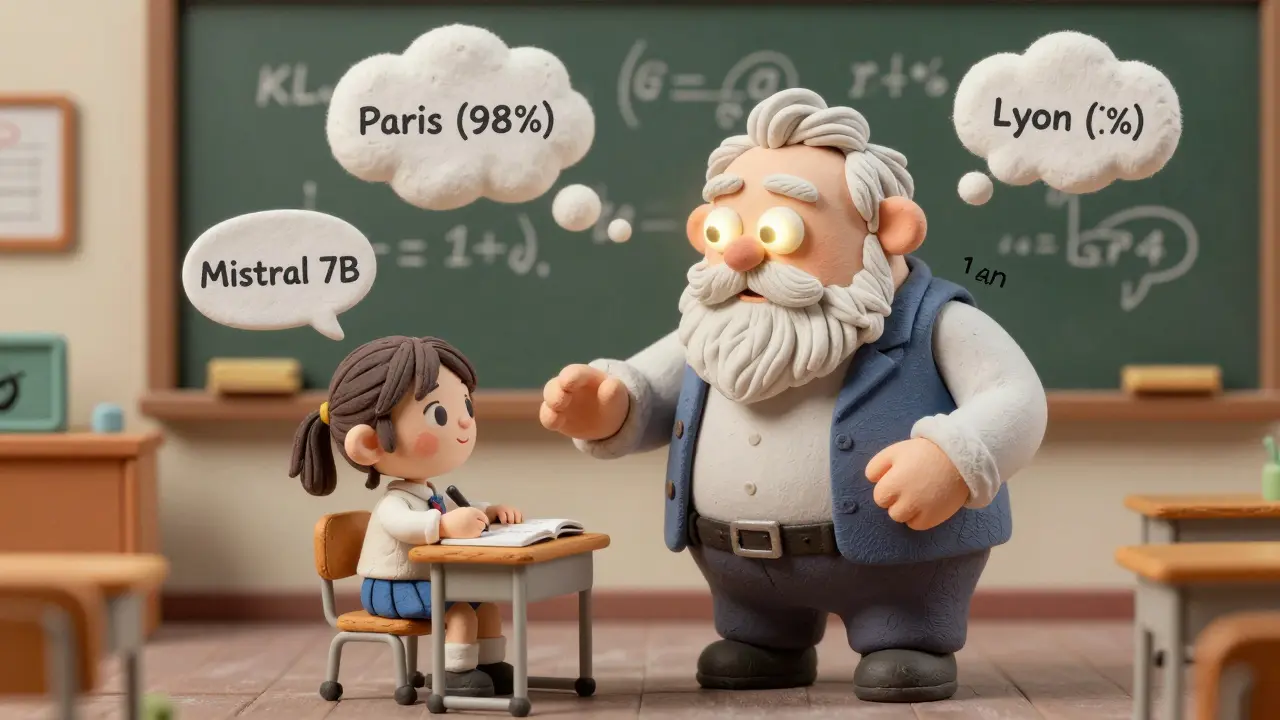

Imaginez un professeur ultra-compétent, capable de résoudre n’importe quel problème en quelques secondes. Mais il est lent, coûteux, et ne tient pas sur un téléphone. Maintenant, imaginez un élève brillant, qui n’a pas la même mémoire, mais qui écoute attentivement le professeur, apprend ses raisonnements, et finit par répondre presque aussi bien - mais en 1/7e du temps. C’est exactement ce que fait la distillation.

Le modèle professeur (comme GPT-4 ou Llama 3) analyse des données et produit non pas juste une réponse finale, mais une distribution de probabilités. Par exemple, pour la question « Quelle est la capitale de la France ? », au lieu de dire simplement « Paris », il dira : « Paris (98 %), Lyon (1 %), Marseille (0,5 %), autres (0,5 %) ». Cette nuance, appelée soft target, contient bien plus d’information qu’une simple réponse correcte. C’est ce que l’élève (un modèle plus petit comme Mistral 7B ou un BERT distillé) apprend à reproduire.

Le processus utilise une fonction mathématique appelée KL divergence, qui mesure à quel point les prédictions de l’élève s’écartent de celles du professeur. L’objectif ? Minimiser cette différence. Résultat : un modèle 10 fois plus petit qui garde 90 à 95 % des performances du modèle original.

Les avantages concrets : moins de coûts, plus de vitesse

Les entreprises ne cherchent pas juste à faire de l’IA. Elles veulent l’utiliser partout - sur les smartphones, dans les voitures, dans les centres d’appel, sur les capteurs industriels. Les gros modèles ne peuvent pas faire ça. Voici ce que la distillation change en pratique :

- Coûts d’inference réduits de 65 à 80 % : chez AWS Bedrock, passer d’un modèle de 70 milliards de paramètres à un modèle distillé de 7 milliards réduit le coût de traitement de 0,002 $ par 1 000 tokens à 0,0007 $.

- Latence divisée par 7 : un modèle original peut prendre 500 ms pour répondre. Son équivalent distillé le fait en 70 ms - suffisamment rapide pour des applications en temps réel comme les assistants vocaux ou les chatbots.

- Moins de données nécessaires : la distillation utilise des prédictions synthétiques du professeur, donc elle n’a besoin que de 1/10e des données étiquetées qu’exige le fine-tuning traditionnel.

C’est pourquoi 78 % des entreprises qui adoptent l’IA en 2024 le font pour déployer des modèles sur des appareils à ressources limitées, selon O’Reilly. Et selon IDC, d’ici 2026, 65 % des déploiements d’IA en entreprise utiliseront des modèles distillés.

Quand ça marche - et quand ça échoue

La distillation n’est pas une solution magique. Elle excelle dans certains cas, mais échoue dans d’autres.

Elle fonctionne très bien pour :

- Les chatbots de service client : 87 % des questions sont résolues aussi bien que par le modèle original (IBM, 2024).

- Les classifications de texte : sur le jeu de données SNLI, les modèles distillés atteignent 92,7 % de précision.

- Les applications mobiles ou embarquées : un modèle de 7 milliards de paramètres tient sur un smartphone moderne.

Elle échoue quand :

- Il faut une compréhension profonde : dans l’analyse juridique, un modèle distillé atteint seulement 72 % de précision contre 89 % pour le professeur (IBM, 2024).

- Les raisonnements multi-étapes sont nécessaires : une question comme « Si un client demande un remboursement après avoir utilisé un service pendant 3 mois, quelles clauses du contrat s’appliquent ? » dépasse souvent la capacité d’un modèle distillé.

- Le professeur est biaisé : si le modèle original a des préjugés de genre ou de race, la distillation les copie - et parfois les amplifie. Une étude a montré une augmentation de 12,3 % des biais de genre dans les modèles distillés de sentiment.

Les outils du marché en 2026

La distillation n’est plus une idée de laboratoire. Elle est devenue un standard industriel.

- Amazon Bedrock : lancé en version prévue en avril 2024, il permet de distiller des modèles jusqu’à 70 milliards de paramètres en modèles de 7 milliards. Il génère automatiquement jusqu’à 15 000 paires question-réponse pour l’entraînement.

- Google Vertex AI : a ajouté la distillation en décembre 2023. Son approche « step-by-step » enseigne non seulement les réponses, mais aussi les raisonnements intermédiaires, avec 87,5 % moins de données d’entraînement.

- Hugging Face : avec DistilBERT (téléchargé 4,2 millions de fois par mois), il a démocratisé la distillation pour les développeurs. C’est la première étape pour beaucoup qui veulent tester sans investir dans des infrastructures coûteuses.

Le marché des outils d’optimisation d’IA devrait passer de 2,8 milliards de dollars en 2024 à 9,4 milliards en 2028, selon MarketsandMarkets. Et la concurrence s’intensifie : Meta travaille sur la « self-distillation », où un modèle s’améliore lui-même en se reproduisant, avec des gains de 8,7 % en raisonnement selon leur prépublication de mai 2024.

Les pièges à éviter

Beaucoup pensent que la distillation est juste une question de « réduire la taille ». Ce n’est pas vrai. Voici trois erreurs courantes :

- Choisir un élève trop petit : AWS recommande de ne pas descendre en dessous de 1/10e du nombre de paramètres du professeur. Un modèle de 7B peut être distillé à partir d’un modèle de 70B, mais pas d’un modèle de 10B.

- Ignorer les hallucinations du professeur : si le professeur invente des faits, l’élève les apprend aussi. Il faut vérifier manuellement 15 à 20 % des données synthétiques générées.

- Ne pas calibrer la température : la température contrôle la « créativité » des prédictions du professeur. Une valeur trop basse (0,3) rend les réponses trop rigides. Une valeur trop élevée (1,2) les rend trop bruitées. L’optimum ? Entre 0,6 et 0,8, selon Google.

Et attention : la distillation ne crée pas de nouvelles connaissances. Elle ne peut pas dépasser la capacité du professeur. Si le professeur ne sait pas faire quelque chose, l’élève non plus.

Et demain ?

Le futur de l’IA générative ne sera pas seulement dans les modèles géants. Il sera dans les modèles intelligents, rapides, et légers. La distillation permettra d’installer des assistants d’IA sur des appareils connectés, dans les hôpitaux, dans les usines, même dans les régions sans connexion Internet stable.

Les chercheurs travaillent déjà sur la « distillation itérative » : un modèle distillé devient lui-même professeur pour un nouveau modèle encore plus petit. Et la « self-distillation » pourrait permettre à un modèle de s’améliorer sans données externes.

Mais il y a un prix : la transparence. L’UE exige maintenant que les systèmes d’IA documentent la provenance des données synthétiques. AWS a répondu avec son feature « distillation provenance », qui trace la version du professeur, les scores de confiance, et les sources des données. Sans ça, les modèles deviennent des boîtes noires - et les erreurs, des mystères.

En 2027, 80 % des déploiements d’IA en production utiliseront la distillation, selon Forrester. Mais les modèles complets resteront indispensables pour les tâches critiques : diagnostic médical, justice, recherche scientifique. La distillation n’élimine pas les géants. Elle les rend accessibles - et c’est là son vrai pouvoir.

Quelle est la différence entre la distillation et la quantification ?

La quantification réduit la précision des nombres dans le modèle (par exemple, passer de nombres à virgule flottante 32 bits à 8 bits). Cela diminue la taille et la consommation, mais fait perdre en finesse des prédictions. La distillation, elle, garde la structure et la logique du modèle original en apprenant ses comportements, même si le modèle est plus petit. Elle préserve mieux la capacité de raisonnement.

Est-ce que la distillation réduit les biais ?

Non, au contraire. La distillation copie les biais du modèle professeur, et parfois les amplifie. Si le professeur associe « médecin » à « homme » et « infirmière » à « femme », l’élève apprendra la même association. Il faut des techniques supplémentaires - comme l’équilibrage des données ou la détection de biais - pour corriger ça.

Puis-je faire de la distillation avec un modèle open-source ?

Oui. Hugging Face propose des outils pour distiller des modèles comme Llama 3 ou Mistral avec seulement quelques lignes de code. Vous avez besoin d’un GPU, d’un peu de code en PyTorch, et d’un modèle professeur déjà entraîné. C’est plus technique que d’utiliser AWS Bedrock, mais c’est possible sans dépenser des millions.

Quelle taille de modèle est idéale pour un chatbot d’entreprise ?

Un modèle distillé de 7 à 13 milliards de paramètres fonctionne très bien pour les chatbots. Il peut répondre à 85-90 % des questions sans erreur, avec une latence inférieure à 100 ms. Des modèles plus petits (3B) sont rapides, mais leur précision chute nettement sur les questions complexes ou ambiguës.

Faut-il toujours utiliser un modèle professeur très grand ?

Pas forcément. Un modèle de 13B peut être un bon professeur pour un élève de 1,5B. L’important, c’est la qualité des données et la cohérence des réponses. Un professeur trop grand peut être plus lent à entraîner et plus sujet aux hallucinations. Parfois, un professeur modéré, bien contrôlé, donne de meilleurs résultats qu’un géant mal calibré.