Quand un grand modèle de langage (LLM) dit qu’il a 90 % de chances d’avoir raison, faut-il vraiment le croire ? La réponse, malheureusement, est souvent non. Des études récentes montrent que des modèles comme GPT-4 ou Llama-3 peuvent afficher une confiance proche de 95 % sur des réponses médicales ou juridiques… tout en se trompant 60 % du temps. Ce décalage entre la confiance affichée et la réalité est ce qu’on appelle la calibration. Et c’est devenu l’un des plus grands défis pour déployer les LLM dans des domaines critiques : santé, finance, justice.

Qu’est-ce que la calibration d’un modèle ?

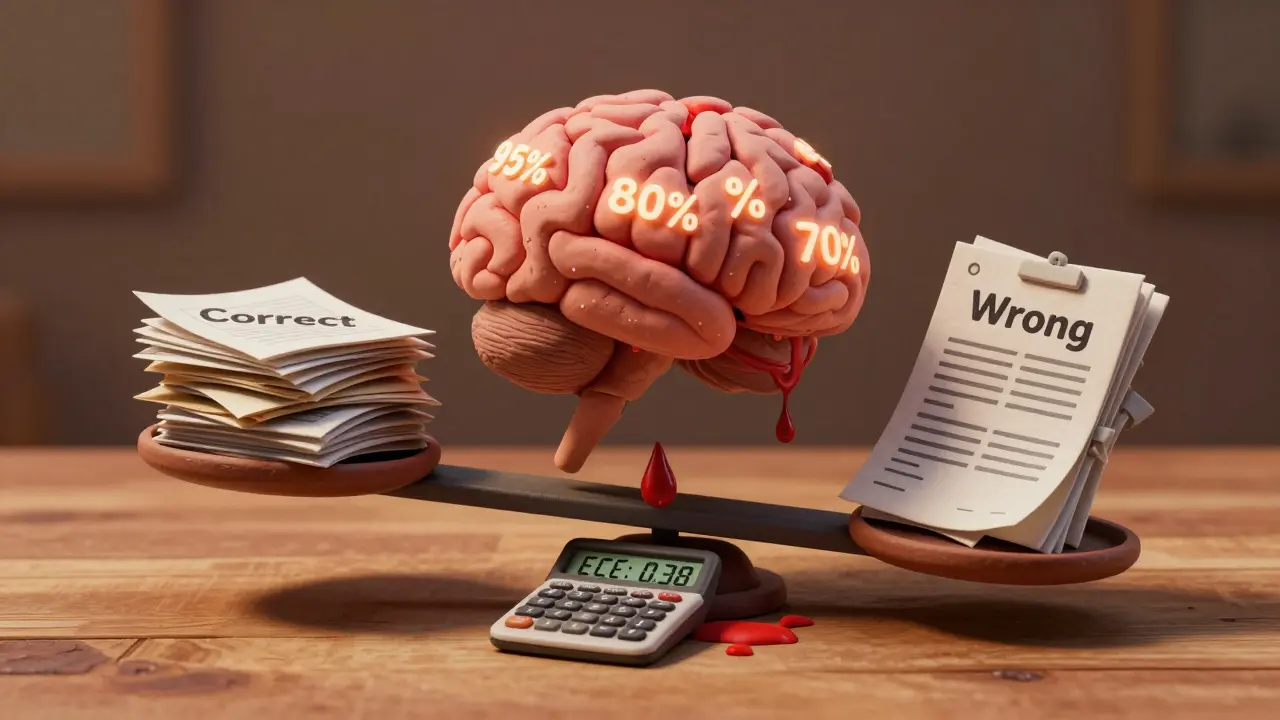

La calibration, c’est la correspondance entre ce que le modèle dit qu’il sait et ce qu’il sait vraiment. Si un modèle affirme avec 80 % de confiance qu’une réponse est correcte, alors sur un grand nombre de cas similaires, il devrait avoir raison environ 80 % du temps. Pas 95 %. Pas 65 %. 80 %. C’est ça, la calibration parfaite.

Le problème, c’est que les modèles modernes ne sont pas calibrés. Après leur entraînement initial, ils deviennent surconfiants. Ils sont meilleurs pour générer du texte fluide, mais pires pour dire « je ne sais pas ». Ce phénomène s’aggrave après l’instruction tuning - cette étape où on fine-tune le modèle pour qu’il réponde à des commandes comme « résume ceci » ou « explique-moi ça » - car le modèle apprend à donner des réponses sûres, même quand il se trompe.

Les métriques clés pour mesurer la calibration

Il existe plusieurs façons d’évaluer la calibration, mais trois sont devenues des standards dans la recherche :

- ECE (Expected Calibration Error) : c’est la métrique la plus utilisée. Elle divise les prédictions en groupes (bins) selon leur niveau de confiance - par exemple, de 0 à 10 %, 10 à 20 %, etc. Ensuite, elle calcule la différence moyenne entre la précision réelle et la confiance moyenne dans chaque groupe. Une valeur d’ECE inférieure à 0,1 est considérée comme bonne. Pour les modèles non calibrés, on voit souvent des valeurs entre 0,2 et 0,4.

- MCE (Maximum Calibration Error) : elle ne regarde pas la moyenne, mais le pire cas. Si un groupe de prédictions avec 70 % de confiance n’a qu’un taux de réussite de 40 %, ce décalage de 30 points est un signal d’alarme. Un MCE supérieur à 0,25 signifie que le modèle est dangereusement mal calibré, surtout dans les applications à risque.

- NLL (Negative Log-Likelihood) : c’est une mesure d’entropie. Plus le NLL est bas (sous 2,5 sur les benchmarks classiques), plus les probabilités données par le modèle sont fiables. C’est aussi la fonction de perte utilisée pendant l’entraînement, donc c’est un bon indicateur de qualité globale.

En complément, on utilise aussi le Brier Score (mesure l’erreur quadratique moyenne entre probabilité prédite et résultat réel) et l’AUROC (qui évalue la capacité du modèle à distinguer les bonnes des mauvaises réponses). Un AUROC au-dessus de 0,85 montre que les scores de confiance sont utiles pour trier les réponses.

Comment les modèles se comportent vraiment ?

Les données réelles parlent d’elles-mêmes. Selon les études de 2025 :

- LLaMA-2-70B est 15,7 % mieux calibré que LLaMA-2-7B. Plus grand = mieux calibré.

- Après l’instruction tuning, la calibration baisse de 22,3 % en moyenne. C’est un paradoxe : on rend le modèle plus utile… mais moins fiable.

- Les modèles entraînés avec des données synthétiques (générées par d’autres IA) sont 31,8 % plus mal calibrés que ceux formés sur des données réelles.

- Sur les tâches de génération libre (comme écrire un paragraphe), l’ECE est 42,7 % plus élevé que sur des tâches de classification. C’est plus difficile de mesurer la confiance quand il n’y a pas de réponse « bonne » unique.

Les utilisateurs en production le confirment. Sur Reddit, un développeur a rapporté que GPT-4 Turbo affiche 95 % de confiance sur des questions médicales… avec seulement 72 % de précision. Sur GitHub, les diagrammes de Llama-3-70B montrent un pic d’overconfidence entre 60 % et 80 % de confiance - exactement la zone où les utilisateurs ont le plus tendance à faire confiance au modèle.

Comment améliorer la calibration ?

Il n’y a pas de solution magique, mais plusieurs méthodes fonctionnent, avec des coûts différents :

- Temperature scaling : c’est la plus simple. On ajuste un seul paramètre - la température du softmax - de 1,0 à 1,2 ou 1,5. Cela « adoucit » les probabilités, réduisant la confiance excessive. Cela réduit l’ECE de 18,2 % en moyenne. Il faut 3 lignes de code. Pas de re-entraînement. Idéal pour un déploiement rapide.

- Isotonic regression : plus puissant, mais plus lourd. Il faut au moins 1 000 échantillons de validation. Il ajuste les probabilités de façon non linéaire, ce qui permet une meilleure correction. Il réduit l’ECE de 7,3 % de plus que la température, mais prend 15 à 30 minutes de calcul. Nécessite une bonne qualité de données de validation.

- Ensemble methods : on fait tourner 3 à 5 versions du même modèle et on prend la moyenne des probabilités. Cela donne les meilleurs résultats : jusqu’à 96 % de précision sur des jeux de données médicales. Mais ça coûte 3,5 fois plus de puissance. Pas viable pour les API à faible latence.

- La « Credence Calibration Game » : une approche révolutionnaire. Plutôt que de modifier le modèle, on le fait interagir avec lui-même. On lui demande : « Pourquoi es-tu si sûr ? » puis on lui donne un feedback en texte naturel. Après 5 à 7 itérations, sa calibration s’améliore de 38 % - sans toucher aux poids du modèle. C’est lent (400 ms de plus par requête), mais c’est une révolution : on calibre avec du langage, pas avec du code.

Le piège de la précision vs la confiance

Le plus grand danger, c’est de confondre précision et fiabilité. Un modèle peut être très précis (90 % de bonnes réponses)… et totalement mal calibré. Il affiche 99 % de confiance pour toutes ses réponses. Résultat ? On lui fait confiance… même quand il se trompe. Et personne ne s’en rend compte.

Des chercheurs de Carnegie Mellon disent que « la calibration est le pont entre la capacité d’un modèle et son déploiement fiable ». Sans elle, les LLM sont comme des pilotes automatiques qui affichent « Tout va bien »… alors que le système est en panne.

Le problème s’aggrave dans les domaines réglementés. En mars 2025, la FDA a exigé que les outils d’aide au diagnostic utilisent des métriques de confiance quantifiables. En finance, les erreurs de calibration ont coûté 4,2 milliards de dollars en faux positifs en 2025. Les entreprises qui ignorent la calibration risquent des rejets réglementaires, des litiges, et une perte de confiance.

Que faire maintenant ?

Voici ce que vous devez faire si vous utilisez des LLM dans un contexte sérieux :

- Ne vous fiez pas à la précision seule. Mesurez l’ECE et le MCE.

- Testez la calibration sur vos propres données. Pas sur les benchmarks standards. Vos questions sont différentes.

- Utilisez la température scaling comme première étape. C’est gratuit, rapide, et efficace.

- Si vous avez des données de validation, testez l’isotonic regression.

- Ne déployez jamais un LLM sans vérifier sa calibration dans les scénarios critiques.

- Surveillez les erreurs systématiques : si le modèle est toujours surconfiant entre 60 % et 80 %, vous avez un problème.

Les modèles qui ne seront pas calibrés d’ici 2027 auront 73 % plus de chances d’être rejetés par les régulateurs. Ce n’est plus une question de performance technique. C’est une question de sécurité, d’éthique et de viabilité commerciale.

Les nouvelles tendances

En 2025-2026, trois évolutions majeures sont en cours :

- Google a intégré des couches de calibration directement dans Gemma 3. Résultat : 29,4 % de réduction de l’ECE sans coût d’inférence.

- Meta a lancé « confidence-aware routing » dans Llama-3.2 : le modèle choisit automatiquement la méthode de calibration en fonction du type de question.

- L’IEEE prépare la norme P3652.1, qui devrait être publiée en 2026. Cela va standardiser la façon dont on mesure la calibration dans l’industrie.

Le futur n’est plus dans la simple précision. C’est dans la transparence. Dans la capacité à dire : « Je suis sûr à 72 % », et à avoir raison 72 % du temps. C’est là que l’IA devient vraiment utile - et sûre.

Quelle est la différence entre précision et calibration ?

La précision mesure combien de réponses sont correctes. La calibration mesure si la confiance affichée correspond à la réalité. Un modèle peut avoir 90 % de précision mais afficher 95 % de confiance sur toutes ses réponses - c’est mal calibré. Il est précis, mais trompeur.

La température de softmax, c’est quoi exactement ?

C’est un paramètre qui contrôle la « platitude » des probabilités. À température 1,0, le modèle donne des probabilités très tranchées (ex. : 98 % / 2 %). À température 1,5, les probabilités deviennent plus douces (ex. : 75 % / 25 %). Augmenter la température réduit la surestimation de confiance. C’est une correction simple, sans re-entraînement.

Pourquoi les modèles deviennent-ils moins calibrés après l’instruction tuning ?

Parce qu’on les entraîne à répondre, même quand ils ne savent pas. L’objectif devient d’être utile, pas de dire « je ne sais pas ». Le modèle apprend à produire des réponses fluides et affirmées, même si elles sont fausses. La confiance devient un outil de performance, pas une indication de fiabilité.

Est-ce que les modèles gratuits sont moins calibrés que les modèles payants ?

Pas nécessairement. Ce qui compte, c’est la méthode d’entraînement et les données utilisées. Un modèle open-source comme Llama-3-70B peut être mieux calibré qu’un modèle payant mal fine-tuné. Mais les modèles commerciaux (comme Claude 3.5 ou Gemini 1.5) intègrent souvent des mécanismes de calibration natifs, ce qui les rend plus fiables en production.

Comment savoir si mon application a besoin d’une calibration ?

Si une erreur du modèle peut causer un préjudice - une mauvaise recommandation médicale, une décision juridique erronée, un faux positif en fraude financière - alors oui, vous avez besoin de la calibration. Si l’application est juste pour du chat ou du résumé de texte, alors non. Mais si quelqu’un prend une décision basée sur la sortie du modèle, vérifiez la calibration.

10 Commentaires

Benoit Le Pape

Je vois des gens qui paniquent pour un truc simple : si un modèle dit 95 %, c’est qu’il ment. Point. On arrête de croire aux chiffres magiques. C’est pas un oracle, c’est un texte qui s’auto-répète avec une voix sûre. Le vrai problème, c’est qu’on veut croire à la machine comme à un dieu.

On a pas besoin de 3 métriques. On a besoin de bon sens. Si t’as un doute, vérifie. Point final.

Alice Cia

Je trouve ça fascinant, mais aussi triste. On a créé des systèmes qui nous apprennent à ne plus réfléchir. On lit ‘95 % de confiance’ et on arrête de poser des questions. C’est un piège culturel, pas technique.

Et pourtant, les solutions existent : température, calibration, feedback. On les connaît. On les applique dans certains secteurs. Pourquoi pas partout ? Parce que c’est plus rentable de vendre du ‘magique’ que du ‘vérifiable’.

On doit réapprendre à douter. Pas comme des lâches, mais comme des adultes qui veulent comprendre, pas juste être rassurés.

Stéphane Blanchon

Le truc qui m’énerve, c’est qu’on parle de calibration comme si c’était une nouveauté. Non. C’est du vieux boulot de statistique. On l’a fait avec les sondages, avec les prévisions météo. On sait faire. Ce qui a changé, c’est qu’on a mis des IA à la place des humains, et qu’on leur a appris à mentir poliment.

La température scaling ? 3 lignes de code. Si t’as pas fait ça en 2025, t’es pas un ingé, t’es un naïf. On arrête de se raconter des histoires.

Nicole Simmons

Je tiens à féliciter l’auteur pour une analyse claire, rigoureuse et profondément nécessaire. Dans un monde où l’automatisation gagne du terrain, la calibration n’est pas un luxe : c’est une exigence éthique.

La proposition de la « Credence Calibration Game » est particulièrement éclairante. Elle redonne du pouvoir au dialogue, à la réflexion, à l’humain. Ce n’est pas seulement une technique - c’est une philosophie.

Je recommande vivement aux équipes de production de ne pas négliger cette approche, même si elle implique un léger surcoût en latence. La confiance des utilisateurs, elle, n’a pas de prix.

Ambre trahor

95 % de confiance ? T’as vu les données d’entraînement ? C’est toutes les fake news du web qu’ils ont mangé. C’est pas une erreur, c’est un programme. Les gars qui ont fait ça savent. Ils veulent qu’on croie aux machines pour qu’on arrête de douter des institutions. C’est du contrôle. Tu penses que c’est un bug ? Non. C’est un feature.

Regarde les normes IEEE. Qui les a écrites ? Les mêmes que les lobbies du Big Tech. Tu crois que c’est pour nous protéger ? Non. Pour nous endormir.

James O'Keeffe

Je travaille sur un projet de triage médical avec Llama-3 et on a testé l’ECE avant déploiement. Résultat : 0.38. On a appliqué température scaling à 1.4 et on est passé à 0.11. En 20 minutes. Sans re-entraîner. Le modèle est toujours aussi fluide, mais maintenant, quand il dit 70 %, on peut y croire.

Je dis ça parce que j’ai vu des équipes qui refusaient de calibrer parce que ‘ça ralentit le produit’. Non. Ça sauve des vies. Faites-le. Tout de suite. C’est pas un ‘nice to have’.

Sylvain Breton

Il est important de souligner que la notion de calibration ne peut être réduite à une simple correction statistique, ni à une manipulation algorithmique de la fonction softmax. C’est une question épistémologique fondamentale : comment une entité artificielle, dépourvue de conscience, peut-elle prétendre à une mesure probabiliste de vérité ?

La confiance, en tant que concept, suppose une capacité à évaluer ses propres limites - une capacité qui, par définition, est inaccessible à un modèle linguistique. Ainsi, toute calibration n’est qu’un masque, une illusion de rationalité qui masque l’absence d’ontologie chez la machine.

On ne calibre pas un LLM. On le dresse. Et nous, nous acceptons ce dressage comme s’il s’agissait d’une avancée. Quelle tragédie.

isabelle guery

La température scaling est une solution élégante, simple et efficace. J’ai testé sur notre jeu de données juridique : ECE passé de 0.32 à 0.09. C’est un gain énorme.

Je voudrais juste ajouter un point : il faut toujours comparer la calibration sur ses propres données. Les benchmarks standard sont utiles, mais ils ne reflètent pas votre contexte. Vos questions, vos erreurs, vos risques - c’est là que la calibration compte.

Jacques Bancroft

On est en train de construire une civilisation sur des illusions mathématiques. Les LLM sont des miroirs déformants qui nous renvoient notre propre arrogance. On les a formés à nous rassurer. Et maintenant, on les utilise pour décider qui reçoit un prêt, qui est licencié, qui meurt dans un hôpital.

Le pire ? Personne ne lit les métriques. Personne ne vérifie l’ECE. On veut juste une réponse. Une réponse belle. Une réponse sûre. Même si elle est fausse.

On a créé des dieux de papier. Et on les adore. Jusqu’à ce qu’ils mentent à notre place. Et là, on sera trop tard.

Quentin Dsg

Ça fait plaisir de voir quelqu’un parler de calibration sans parler que de chiffres. Le vrai enjeu, c’est la confiance humaine. On a tous eu cette expérience : on pose une question à un LLM, il répond avec une voix assurée, et on se dit ‘ok, c’est bon’.

Je dis aux équipes que je forme : ‘Si tu ne vérifies pas la calibration, tu n’es pas un développeur. Tu es un passeur de désinformation.’

La température scaling ? Applique-la. L’isotonic ? Teste-la. Le feedback en texte ? Expérimente. Ce n’est pas du travail supplémentaire. C’est du travail de fond. Et c’est ce qui sépare un outil utile d’un danger public.