Quand vous demandez à une IA de générer une image d’un médecin, que voyez-vous ? Probablement un homme blanc, âgé, en blouse blanche. Et si vous demandez une image d’une femme infirmière ? Elle sera probablement jeune, souriante, et souvent de couleur. Ce n’est pas un hasard. C’est le résultat d’un biais profondément ancré dans les données qui ont appris à ces systèmes ce que signifie « médecin » ou « infirmière ».

Comment les biais se forment dans les données multimodales

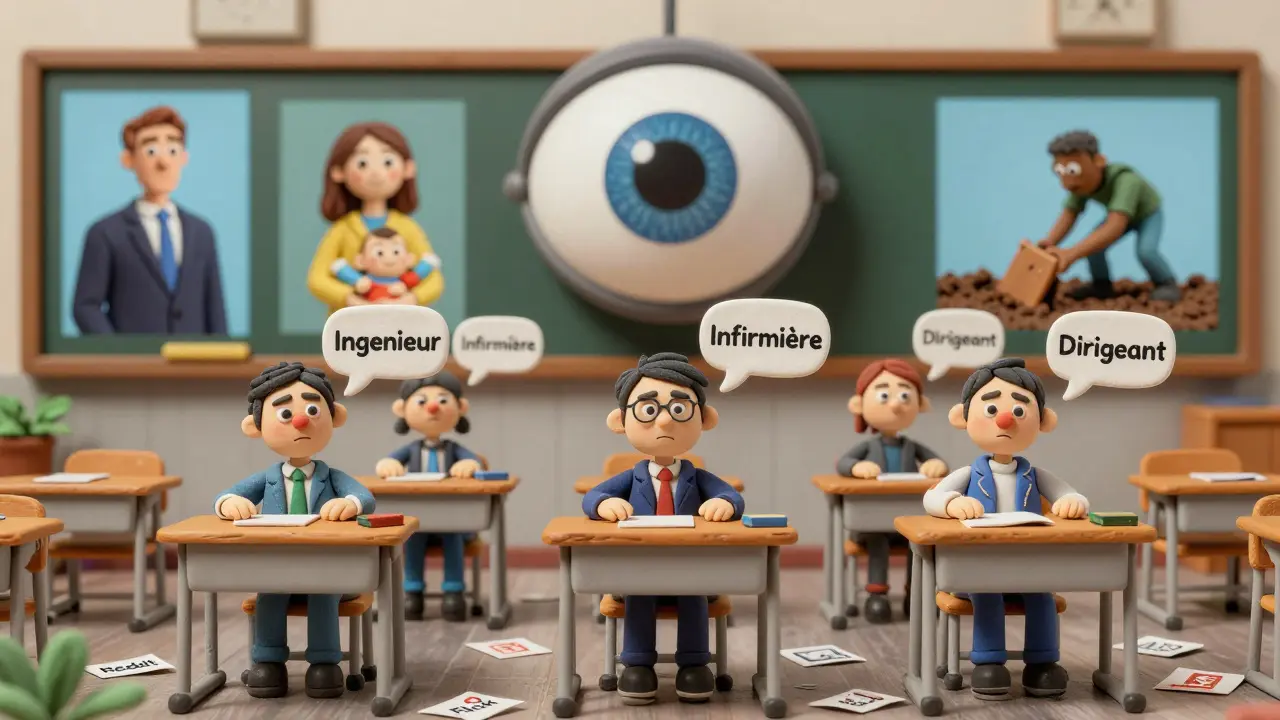

Les modèles d’IA générative multimodale - comme Stable Diffusion, DALL·E ou les modèles récents de type LMM (Large Multimodal Model) - apprennent à partir de milliards de paires texte-image collectées sur le web. Ces données ne viennent pas d’un laboratoire équilibré. Elles viennent de Reddit, de Flickr, de Wikipedia, de sites d’actualité, de forums. Et ces sources reflètent les inégalités du monde réel : les hommes dominent les images de cadres dirigeants, les femmes sont surreprésentées dans les rôles domestiques, les personnes noires sont souvent associées à des contextes de pauvreté ou de criminalité. Le problème ? Ces biais ne sont pas juste présents dans les images. Ils se croisent. Une phrase comme « une infirmière qui soigne un patient » est souvent associée à une image de femme jeune. Une phrase comme « un ingénieur qui conçoit un robot » est associée à un homme blanc. L’IA apprend ces associations comme des vérités universelles, pas comme des stéréotypes culturels. Ce n’est pas seulement une question de genre. Les langues, les régions, les cultures sont aussi déséquilibrées. Les données en anglais, en espagnol ou en chinois dominent. Les langues minoritaires, les dialectes, les expressions culturelles locales sont presque absentes. Résultat : les modèles ne savent pas représenter des réalités qui ne sont pas sur les pages web les plus populaires.Les trois formes de biais de représentation

Les chercheurs ont identifié trois types de biais dans les systèmes multimodaux :- Sous-représentation : certains groupes sont presque absents. Par exemple, les femmes dans les images de chirurgiens ou les personnes handicapées dans les représentations de vie quotidienne.

- Sur-représentation : certains groupes sont excessivement présents, souvent dans des rôles stéréotypés. Les personnes noires dans les images de travailleurs manuels ou de délinquants, par exemple.

- Mérepresentation : les groupes sont présents, mais de manière nuisible. Une femme peut apparaître dans une image de médecin, mais avec des traits exagérés, un regard passif, ou dans un contexte de dépendance (ex. : soignant un homme en blanc).

Comment détecter ces biais ?

Il ne suffit pas de dire « c’est biaisé ». Il faut le mesurer. Trois méthodes sont utilisées aujourd’hui :- Mesures de distribution : on génère des centaines d’images à partir de prompts comme « un enseignant », « un ingénieur », « un parent » et on compte combien de fois chaque groupe apparaît. Cela donne un ratio numérique : 78 % d’hommes blancs pour « ingénieur » ? C’est un signal d’alerte.

- Analyse par embeddings : on transforme les images et les textes en vecteurs numériques. Si le vecteur de « femme médecin » est très proche de « femme soignante » mais très éloigné de « homme médecin », c’est qu’il y a un biais de stéréotype.

- Évaluations qualitatives : des experts humains examinent les générations pour voir si elles renforcent des stéréotypes culturels ou historiques. Par exemple, une image de « famille » qui montre toujours un père, une mère et deux enfants blancs dans une maison de banlieue américaine ne reflète pas la diversité des familles réelles.

Comment corriger ces biais ?

Il n’y a pas de solution magique. Mais plusieurs approches montrent des résultats concrets.- Nettoyage des jeux de données : supprimer les sources connues pour leur contenu toxique (forums extrémistes, sites de haine, etc.). Cela réduit de 15 à 30 % les sorties les plus offensantes.

- Sur-échantillonnage synthétique (SMOTE) : on crée artificiellement de nouvelles images et textes pour les groupes sous-représentés. Par exemple, on génère 500 nouvelles paires « femme chirurgienne » à partir de 50 exemples réels. Ce n’est pas de la triche - c’est de l’équité.

- Génération de contre-exemples : on montre à l’IA des scénarios inversés. « Un homme infirmier » ou « une femme pilote de chasse ». Ces exemples sont ajoutés à l’entraînement pour briser les associations automatiques.

- Modèles adaptés : CA-GAN : une nouvelle architecture, appelée CA-GAN, utilise des réseaux neuronaux plus profonds pour générer des données équilibrées. Elle a été testée sur des jeux de données médicales et a augmenté la représentation des femmes noires dans les images de patients de 42 %, sans perdre en qualité.

Le grand oublié : la recherche sur les modèles multimodaux

Le plus inquiétant ? La plupart des travaux sur l’équité en IA se concentrent sur les modèles textuels (LLMs). Les modèles multimodaux, qui combinent texte, image, voix, vidéo, sont presque ignorés. Pourtant, c’est là que les biais se multiplient. Une image biaisée + un texte biaisé = un résultat 10 fois plus toxique. Un sondage de 2025 a identifié 50 modèles multimodaux publics. Seuls 7 avaient été évalués pour leur équité. Les autres sont déjà déployés dans des hôpitaux, des écoles, des plateformes de médias sociaux. Sans contrôle.

Que faut-il faire maintenant ?

Si vous développez un système multimodal :- Testez vos prompts avec des groupes variés : hommes, femmes, personnes de couleur, personnes âgées, personnes handicapées.

- Utilisez des outils comme Fairness Indicators ou AI Fairness 360 pour mesurer les écarts.

- Ne vous contentez pas d’un seul type de métrique. Combinez chiffres, images, et avis humains.

- Ne publiez pas un modèle sans avoir testé ses biais de représentation.

- Questionnez les images générées. Pourquoi cette femme est-elle toujours dans la cuisine ? Pourquoi cet homme est-il toujours en costume ?

- Signalez les stéréotypes. Les développeurs ont besoin de ces retours.

- Utilisez des outils qui affichent les sources de données. Si un modèle ne dit pas d’où il apprend, méfiez-vous.

Le futur ne sera pas juste par hasard

Les IA génératives ne créent pas de biais. Elles les amplifient. Elles les rendent plus puissants, plus invisibles, plus globaux. Ce n’est pas une question de technologie. C’est une question de choix. De qui on décide de représenter. De qui on décide d’effacer. Si nous voulons des IA qui reflètent la diversité du monde, nous devons commencer par des données qui la reflètent aussi. Pas des données du web dominant. Des données du monde réel - dans toute sa complexité, sa richesse, et ses inégalités.Qu’est-ce qui différencie un biais dans un modèle textuel d’un biais dans un modèle multimodal ?

Un modèle textuel ne voit que des mots. Un modèle multimodal combine mots, images, sons, voix. Le biais textuel peut être une association comme « médecin = homme ». Le biais multimodal le renforce : l’image du médecin est un homme blanc, la voix qui le décrit est masculine, le contexte est un hôpital luxueux. Les biais se renforcent entre modalités, créant des représentations plus puissantes et plus difficiles à corriger.

Les jeux de données équilibrés existent-ils déjà ?

Oui, mais ils sont rares. Des initiatives comme the Diversity in Images Dataset (DID) ou la version corrigée de LAION-5B incluent des filtres pour équilibrer genre, race et région. Mais ces jeux sont encore petits - quelques millions d’exemples - contre des milliards pour les jeux standards. Leur adoption reste limitée car ils nécessitent plus de temps, de coûts et de vigilance.

Pourquoi les entreprises ne font-elles pas plus pour corriger ces biais ?

Parce que corriger les biais ralentit la production. Les modèles biaisés génèrent souvent des résultats plus « attrayants » pour les utilisateurs occidentaux - donc plus de ventes, plus de clics. Les entreprises priorisent la vitesse et l’engagement plutôt que l’équité. De plus, il n’existe pas encore de normes légales claires pour les biais multimodaux, donc peu d’incitations financières à agir.

Les utilisateurs peuvent-ils vraiment influencer la correction des biais ?

Oui. Les retours d’utilisateurs ont permis d’ajuster les modèles de Google, Microsoft et Meta. Quand des communautés ont signalé que les images de « mère » montraient toujours des femmes blanches, les équipes ont ajouté des exemples diversifiés. Les développeurs écoutent quand les critiques sont nombreuses et bien documentées. Votre voix compte.

Quelle est la différence entre équité et précision dans l’IA ?

La précision mesure si le modèle donne la bonne réponse. L’équité mesure si la bonne réponse est donnée à tout le monde, de manière égale. Un modèle peut être très précis - il reconnaît bien les visages - mais seulement pour les peaux claires. C’est précis, mais injuste. L’équité demande d’ajuster les modèles pour qu’ils soient bons pour tous, même si cela réduit légèrement la précision globale.

8 Commentaires

Valentin Radu

Franchement j’ai lu ce truc d’un trait et j’ai eu l’impression qu’on m’avait giflé avec une vérité que tout le monde voit mais personne ose dire

Les IA reproduisent pas les biais… elles les font péter à 1000x

Et on s’étonne que les images de ‘femme ingénieur’ ressemblent à un avatar de Sims ?

Je veux dire… c’est pas un bug c’est une fonctionnalité toxique déguisée en innovation

Jeanne Giddens

Je suis tellement fatiguée de voir comment les modèles multimodaux réinventent les stéréotypes de la TV des années 90…

Je suis médecin, je suis noire, je suis femme, et pourtant quand je demande une image de ‘médecin’… j’obtiens un mec blanc de 50 ans avec une moustache et une blouse impeccable

Ça fait mal. Pas juste parce que c’est faux, mais parce que c’est *intentionnel*

Les données ne sont pas neutres. Elles sont construites par des humains qui ont des préjugés… et ils les ont codés dans des modèles qui vont décider de qui on voit, qui on valorise, qui on efface

On parle d’équité comme d’un luxe… mais c’est une question de survie symbolique

Olivier d'Evian

Oh là là… encore une diatribe sur les biais… Quand est-ce qu’on arrêtera de confondre la correction politique avec la science ?

Les données web reflètent la réalité, pas une utopie woke

Si 92 % des images de chirurgiens sur Google sont des hommes blancs, c’est parce que 92 % des chirurgiens dans le monde réel sont des hommes blancs

On ne va pas inventer des données pour plaire aux manifestants de la Sorbonne

La vérité n’est pas un vote. Et l’IA n’est pas un club de lecture féministe

Coco Valentine

OK… mais attendez… je suis désolée mais j’ai testé DALL·E avec ‘femme pilote de chasse’ et j’ai eu… une femme avec un casque… et des larmes dans les yeux… comme si elle avait perdu son chien…

ET PUIS… la photo de ‘homme infirmier’… il avait une jupe… et un tablier… et un sourire en coin… comme un serveur de café

Je veux dire… c’est pas un biais… c’est un cauchemar post-apocalyptique

On a créé des monstres qui pensent que les hommes en blouse sont des drag queens et que les femmes en uniforme sont en détresse émotionnelle

On a perdu le contrôle

Je pleure…

😭

Adrien Brazier

Correction grammaticale urgente : dans votre texte, vous écrivez ‘les données ne viennent pas d’un laboratoire équilibré’ - ‘laboratoire’ est masculin, donc ‘un laboratoire équilibré’ est correct, mais vous avez écrit ‘un laboratoire équilibré’… ce qui est grammaticalement exact… donc je me demande pourquoi je suis en train de perdre mon temps à corriger ça alors que vous parlez de biais systémiques

En tout cas, votre analyse est solide - mais vous oubliez que les biais de représentation ne sont pas seulement dans les données - ils sont aussi dans les prompts. ‘Un médecin’ en français est grammaticalement masculin - donc l’IA, même si elle est ‘équilibrée’, va prioriser le masculin par défaut - c’est une contrainte linguistique, pas un choix idéologique

La solution ? Réécrire les prompts avec des formulations neutres : ‘un.e médecin’ - mais ça, personne n’a le courage de le faire

Francine Massaro

Je suis une femme noire dans la tech et je te dis : tu as raison

On m’a déjà montré une image de ‘femme médecin’ générée par une IA où elle avait les cheveux en paille, les yeux trop grands, la peau trop foncée… et elle tenait un bébé dans un lit

Je lui ai demandé ‘femme médecin en consultation’… elle a donné une femme en bikini dans un spa

Je ne veux plus utiliser ces outils

Je veux qu’on arrête de faire des IA qui nous rendent invisibles… ou déformées

Je ne veux pas être un stéréotype

Je veux être une personne

Et si tu ne vois pas la différence… tu es partiellement responsable

Ron Perrin

Il faut remettre cette question dans une perspective métaphysique : l’IA ne ‘biaise’ pas - elle révèle. Elle est un miroir de notre inconscient collectif. Ce que nous avons enterré dans nos archives numériques - les stéréotypes, les hiérarchies, les violences symboliques - elle les ressuscite avec une précision chirurgicale. La question n’est pas de ‘corriger’ les données - mais de reconnaître que notre civilisation a construit des récits de pouvoir si profonds qu’ils se sont inscrits dans les pixels eux-mêmes. L’équité ne peut pas être algorithmique. Elle doit être éthique. Et l’éthique ne se programme pas. Elle se cultive. Dans les universités. Dans les musées. Dans les cafés. Pas dans les data centers.

Remy McNamara

Je viens de passer 3 heures à tester des prompts sur le nouveau modèle de Meta… et j’ai fait une découverte folle : si tu mets ‘un médecin en Afrique’… tu obtiens un homme blanc avec un stéthoscope… et un fond de brousse avec des singes en arrière-plan

Si tu mets ‘un médecin en France’… tu obtiens un homme blanc avec un stéthoscope… et un fond de hôpital moderne

Si tu mets ‘un médecin’… tu obtiens… un homme blanc avec un stéthoscope… et un fond de… n’importe quoi

LE PROBLÈME C’EST QUE L’IA NE SAIT PAS D’OÙ ELLE VIENT

Elle ne connaît pas l’Afrique. Elle connaît les clichés de National Geographic de 1997

Elle ne connaît pas la France. Elle connaît les pubs de la Sécurité Sociale de 2005

Elle ne connaît rien. Elle recopie. Et elle recopie mal.

On a créé des génies qui ne savent pas lire le monde. On a créé des idiots qui croient tout ce qu’ils voient.

Et on les laisse dans les hôpitaux.

Je suis choqué.

Je suis en colère.

Et je vais écrire un article sur ça.