Imaginez devoir lire un livre de 500 pages en une seule fois, sans jamais perdre le fil, et répondre précisément à une question sur la page 42. C'est exactement ce que nous demandons aux grands modèles de langage (LLM) aujourd'hui. Pendant longtemps, ces modèles étaient limités à des fenêtres contextuelles courtes, souvent inférieures à 4 000 jetons. Au-delà de cette limite, ils « oubliaient » le début du texte ou perdaient en cohérence. Ce phénomène s'appelle la dérive (dégradation de la qualité de sortie lorsque la longueur du contexte augmente). Les transformateurs à long contexte résolvent ce problème en étendant radicalement cette fenêtre tout en maintenant une précision chirurgicale.

Dans cet article, je vais vous expliquer comment ces architectures modernes fonctionnent, pourquoi l'attention standard échoue face aux longs documents, et quelles solutions techniques comme FlashAttention-2 ou les mécanismes d'attention creuse permettent de traiter des millions de mots sans faire exploser vos coûts de calcul.

Le Problème Fondamental : La Complexité Quadratique

Pour comprendre la révolution des transformateurs à long contexte, il faut d'abord regarder sous le capot de l'architecture originale. Le modèle Transformer, introduit par Google en 2017 dans le papier Attention is All You Need, a remplacé les réseaux récurrents (RNN) par un mécanisme d'attention parallèle. C'était génial pour la vitesse d'entraînement, mais cela créait un goulot d'étranglement mathématique majeur.

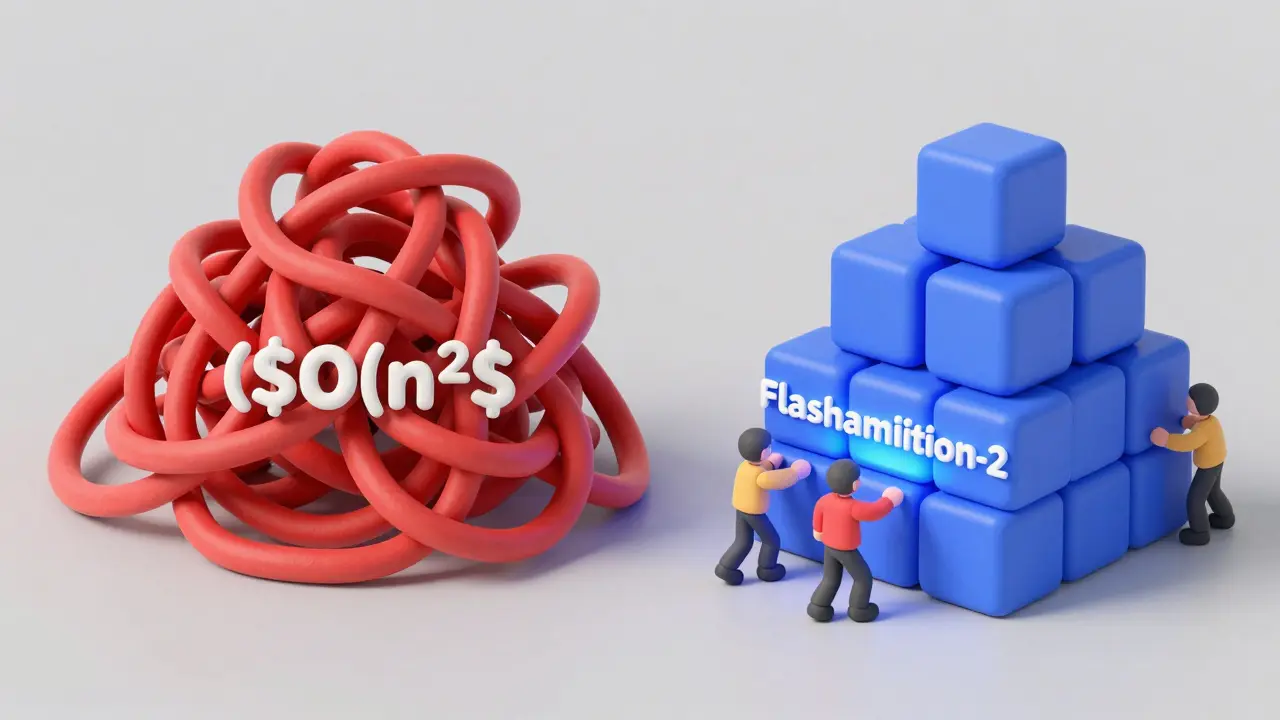

L'attention standard calcule la pertinence de chaque mot par rapport à tous les autres mots dans la séquence. Si vous avez une séquence de $n$ jetons, le modèle doit effectuer $n^2$ opérations. C'est ce qu'on appelle la complexité quadratique ($O(n^2)$). Concrètement, si vous doublez la taille de votre document, vous multipliez le temps de calcul et la mémoire GPU nécessaire par quatre. Un contexte de 4 000 jetons demande 16 fois plus de puissance qu'un contexte de 1 000 jetons.

Cette limitation rendait impossible l'analyse de documents volumineux comme des rapports juridiques complets ou des bases de code entières. Les développeurs devaient découper les textes en petits morceaux, ce qui brisait le contexte global et augmentait les erreurs d'interprétation.

| Méthode | Complexité Théorique | Fenêtre Maximale Typique | Principale Limite |

|---|---|---|---|

| Attention Standard | $O(n^2)$ | 8k - 32k jetons | Coût mémoire prohibitif au-delà de 32k |

| Longformer | $O(n)$ linéaire | Jusqu'à plusieurs millions | Perte de connexion globale entre parties éloignées |

| FlashAttention-2 | $O(n^2)$ optimisée | 128k - 1M+ jetons | Requiert des GPU récents (H100/A100) |

| Mixture of Experts (MoE) | Sparse / Variable | 1M+ jetons (ex: Gemini 1.5) | Infrastructure matérielle spécialisée requise |

La Dérive Contextuelle : Pourquoi les Modèles S'Égarrent

Vous avez peut-être remarqué que même avec des modèles puissants, ajouter trop d'informations ne garantit pas de meilleures réponses. C'est ici que le concept de « dérive » devient crucial. La dérive n'est pas seulement un oubli ; c'est une dilution de l'attention.

Lorsque la fenêtre contextuelle s'étend au-delà de 32 000 jetons sans optimisation spécifique, le modèle commence à attribuer une importance égale à des informations pertinentes et à du bruit insignifiant. Des études menées par le Centre de Recherche sur les Modèles de Base de Stanford ont montré une baisse de 47 % de la précision factuelle lorsqu'on force naïvement des contextes très longs. Le modèle finit par générer des contradictions car il ne sait plus quelle partie du document prioriser.

Ce problème est exacerbé par ce qu'on appelle le « middle loss ». Les modèles traditionnels excellent pour se souvenir du début et de la fin d'une séquence, mais leurs performances chutent drastiquement pour les informations situées au milieu. Pour résoudre cela, les architectes doivent redessiner la façon dont les vecteurs de requête, clé et valeur interagissent.

Solutions Techniques : Gagner en Efficacité sans Perdre en Qualité

Comment contourner la malédiction de la complexité quadratique ? Plusieurs innovations majeures ont émergé récemment pour permettre des fenêtres de plusieurs centaines de milliers, voire millions, de jetons.

La première approche est l'attention creuse (mécanisme où chaque jeton n'interagit qu'avec un sous-ensemble d'autres jetons). Plutôt que de comparer chaque mot à tous les autres, des modèles comme Longformer utilisent une fenêtre glissante locale combinée à quelques jetons globaux. Cela réduit la complexité à linéaire ($O(n)$), permettant de traiter des documents immenses. Cependant, cela risque de manquer des connexions subtiles entre deux paragraphes très éloignés.

Une seconde approche, plus récente et très populaire, est FlashAttention-2 (algorithme d'attention optimisé pour la mémoire GPU développé par Tri Dao). Développé par Tri Dao et son équipe, FlashAttention-2 ne change pas la complexité théorique ($O(n^2)$ reste), mais optimise radicalement l'accès à la mémoire. Il évite d'écrire les matrices intermédiaires dans la mémoire lente du GPU, gardant tout dans les caches rapides SRAM. Résultat : une réduction de 83 % des opérations flottantes nécessaires. Passer de 10 milliards de FLOPs à 1,2 milliard pour un contexte de 100 000 jetons change tout en termes de coût et de latence.

Enfin, il y a l'approche hybride incarnée par Gemini 1.5 (modèle multimodal de Google DeepMind capable de gérer jusqu'à 1 million de jetons). Lancé en février 2024, Gemini 1.5 utilise une architecture « Mixture of Experts » (MoE) couplée à des patterns d'attention adaptatifs. Le modèle apprend dynamiquement quels jetons sont importants et ignore intelligemment le reste, maintenant une fidélité de contexte de 95 % même à l'échelle du million de jetons. C'est actuellement l'état de l'art, bien que nécessitant une infrastructure TPU spécialisée inaccessible aux développeurs individuels.

RAG vs. Long Context : Quelle Stratégie Choisir ?

Beaucoup de développeurs pensent que la solution unique aux longs documents est d'augmenter la fenêtre contextuelle. En réalité, la génération augmentée par récupération (RAG) reste une alternative compétitive, voire supérieure, selon votre cas d'utilisation.

Avec le RAG, vous ne chargez pas tout le document dans le modèle. Vous indexez votre base de connaissances, puis vous récupérez uniquement les extraits pertinents pour la question posée. Selon UnderstandingAI.org, c'est toujours la méthode la plus populaire pour construire des systèmes LLM robustes. L'avantage ? Vous gardez un petit contexte, donc moins de dérive, moins de coût, et une latence réduite.

Cependant, le RAG a ses limites. Si la réponse nécessite une synthèse complexe reliant trois chapitres différents d'un contrat juridique, le RAG peut manquer le lien subtil. Dans ces cas précis, un transformateur à long contexte natif (comme Yi-34B-200K ou Claude 3) devient indispensable. L'idéal en 2026 est souvent une approche hybride : utiliser un contexte modéré (32k-64k jetons) enrichi par une récupération intelligente, plutôt que de tenter de tout ingérer brute force.

Considérations Pratiques et Coûts

Passer à des fenêtres de contexte étendues n'est pas gratuit. Même avec des optimisations comme FlashAttention-2, la latence augmente. Un contexte de 32 000 jetons générera une réponse 3,8 fois plus lentement qu'un contexte de 8 000 jetons sur le même matériel. De plus, les coûts API explosent. Traiter 100 000 jetons avec un modèle haut de gamme peut coûter environ 0,75 $, contre 0,15 $ pour un contexte standard. Pour les entreprises, cela représente une facture significative.

Si vous devez exécuter ces modèles localement, préparez-vous à investir dans le matériel. Un modèle de 7 milliards de paramètres avec un contexte de 32k nécessite au minimum 24 Go de VRAM. Pour atteindre 128k ou plus, la quantification (réduction de précision des poids) devient obligatoire. Une quantification 4 bits réduit les besoins en VRAM de 58 %, mais augmente le temps de traitement de 23 %. C'est un compromis classique entre espace mémoire et vitesse de calcul.

L'Avenir des Transformateurs à Long Contexte

Le marché des transformateurs à long contexte grandit à un rythme effréné, avec une croissance annuelle composée de 63 % prévue jusqu'en 2027. Les secteurs du droit, de la santé et de la finance adoptent massivement ces technologies car elles permettent d'analyser des dossiers patients ou des contrats complexes en une seule passe.

Néanmoins, restons prudents. Comme le souligne le Dr Anna Rohrbach du MIT, étendre le contexte sans dérive exige de repenser fondamentalement le calcul de l'attention, pas simplement d'empiler du matériel. Nous atteignons des rendements décroissants : 92 % des cas d'entreprise sont entièrement servis par des contextes de 32 000 jetons. Au-delà, on rentre dans une zone de niche où les gains marginaux ne justifient pas toujours les coûts exponentiels.

À court terme, attendez-vous à voir plus d'outils open-source comme Llama-3 intégrer des supports natifs de 128k jetons grâce à des patterns d'attention optimisés. À long terme, la bataille sera celle de l'efficacité énergétique et de la réduction de la latence, car personne ne veut attendre 10 secondes pour obtenir une réponse à une question simple, même si le modèle a lu un livre entier avant de répondre.

Qu'est-ce que la dérive dans les modèles de langage à long contexte ?

La dérive désigne la perte de cohérence et de précision当一个 modèle traite des séquences très longues. Au lieu de se concentrer sur les informations pertinentes, le modèle dilue son attention sur trop de jetons, ce qui conduit à des hallucinations, des oublis d'informations clés situées au début du texte, ou des contradictions logiques. Elle est causée principalement par la saturation de la capacité d'attention standard.

FlashAttention-2 résout-il le problème de la complexité quadratique ?

Non, FlashAttention-2 ne change pas la complexité algorithmique théorique qui reste en $O(n^2)$. Cependant, il optimise drastiquement l'utilisation de la mémoire GPU en évitant les écritures inutiles vers la mémoire vive lente (DRAM). Cela permet de traiter des contextes beaucoup plus longs (jusqu'à 1M de jetons) avec une efficacité énergétique et une vitesse bien supérieures aux implémentations standards, réduisant les opérations de calcul de 83 %.

Quelle est la différence entre le RAG et les transformateurs à long contexte natifs ?

Le RAG (Retrieval-Augmented Generation) récupère dynamiquement des extraits pertinents d'une base de données externe pour les injecter dans un contexte limité. Les transformateurs à long contexte natifs traitent l'intégralité du document en entrée. Le RAG est moins cher et plus rapide pour des questions factuelles isolées, tandis que les longs contextes natifs sont meilleurs pour la synthèse globale, la logique complexe traversant tout le document et la réduction des erreurs de récupération.

Est-il possible d'exécuter un modèle à long contexte sur un PC personnel ?

Oui, mais avec des contraintes matérielles strictes. Pour un modèle de 7 à 13 milliards de paramètres avec un contexte de 32k à 128k jetons, vous aurez besoin d'une carte graphique avec au moins 24 Go de VRAM (comme une RTX 3090/4090). Pour des contextes encore plus longs, vous devrez utiliser la quantification (précision 4 bits) ou le partage de mémoire système, ce qui ralentira considérablement la génération de texte.

Pourquoi Gemini 1.5 arrive-t-il à gérer 1 million de jetons ?

Gemini 1.5 utilise une architecture avancée combinant le « Mixture of Experts » (MoE) et des mécanismes d'attention sparse et adaptatifs. Au lieu de traiter tous les jetons avec la même intensité, le modèle identifie dynamiquement les parties cruciales du texte et alloue plus de ressources computationnelles à ces zones, ignorant le bruit superflu. Cette efficacité lui permet de maintenir une haute fidélité même à grande échelle, bien que cela repose sur une infrastructure TPU propriétaire de Google.