Vous avez-vous déjà demandé si vous partagez trop d'informations avec votre assistant IA ? La plupart des utilisateurs envoient entre 69,7 % et 94,3 % de données personnelles inutiles dans leurs requêtes. Ce surplus expose vos systèmes à des risques de mémorisation indésirable et de fuites de confidentialité. La minimisation des données est la pratique consistant à ne partager que le minimum d'informations sensibles nécessaires pour obtenir une réponse utile d'un modèle de langage. Cette approche n'est plus une option, mais une nécessité technique et légale.

Le Principe Fondamental de la Minimisation

La minimisation des données repose sur un concept simple : réduire la surface d'exposition tout en préservant l'utilité de la tâche. En octobre 2024, des chercheurs du Carnegie Mellon University et Stanford University ont publié un cadre de référence intitulé « Operationalizing Data Minimization for Privacy-Preserving LLMs ». Ils définissent cette pratique comme la quantification de la divulgation révélant le moins de privacy possible qui maintient l'utilité pour un prompt donné.

Ce principe s'aligne directement avec les exigences réglementaires actuelles. Le European Data Protection Board (EDPB) a publié des directives en avril 2025 rappelant que toute collecte excessive viole l'article 5(1)(c) du RGPD. Pour les développeurs, cela signifie qu'il faut concevoir des flux de travail où chaque mot envoyé au modèle justifie sa présence par une utilité fonctionnelle directe.

- Identifier les éléments sensibles (PII, codes internes, coordonnées).

- Transformer ces éléments avant leur envoi au modèle.

- Valider que la réponse reste précise malgré les transformations.

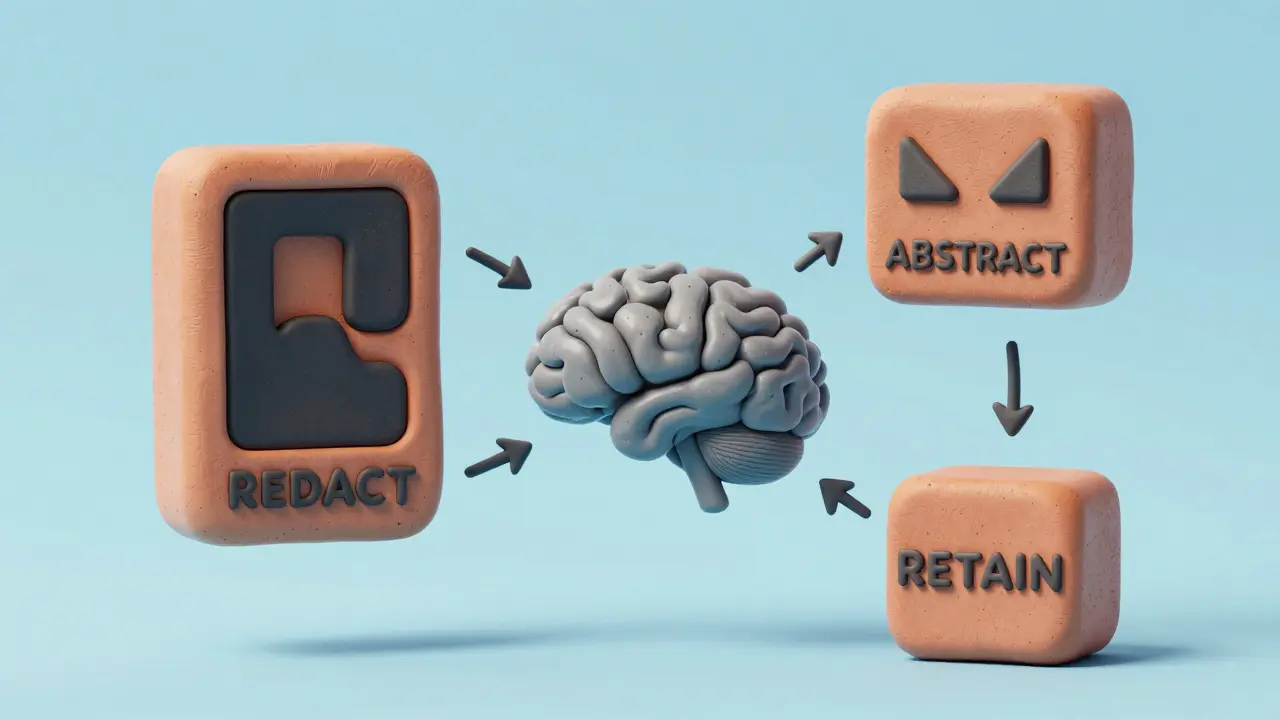

Les Trois Techniques de Transformation Principales

Pour appliquer la minimisation, vous devez choisir parmi trois méthodes principales de transformation du texte. Chaque méthode offre un compromis différent entre sécurité et précision contextuelle.

- REDACT (Redaction) : Suppression complète des informations sensibles. C'est la méthode la plus sûre mais elle peut briser le contexte si utilisée excessivement.

- ABSTRACT (Abstraction) : Remplacement des détails spécifiques par des termes génériques (ex: remplacer "Jean Dupont" par "un client").

- RETAIN (Conservation) : Maintien des informations intactes car jugées essentielles pour la tâche.

Les modèles de classe GPT-4 tolèrent remarquablement bien ces transformations. Sur des conversations ouvertes, ils atteignent 85,7 % de redaction et 8,6 % d'abstraction, ne conservant que 5,7 % des données originales. En revanche, les petits modèles open-source comme qwen2.5-0.5b montrent une résistance beaucoup plus faible, avec seulement 19,3 % de redaction et 69,7 % de conservation nécessaire. Cela indique que la taille du modèle influence directement votre capacité à minimiser les données sans perdre en qualité.

| Type de Modèle | Redaction (%) | Abstraction (%) | Conservation (%) |

|---|---|---|---|

| GPT-4 (Frontier) | 85,7 | 8,6 | 5,7 |

| qwen2.5-0.5b (Petit) | 19,3 | 11,0 | 69,7 |

Implémentation Technique : L'Algorithme de Recherche Arborescente

Comment déterminer le point optimal de minimisation ? Le cadre Carnegie Mellon-Stanford utilise un algorithme de recherche arborescente basé sur une file de priorité. Cet algorithme explore l'espace des transformations possibles, ordonné par niveau de confidentialité, pour identifier la configuration qui préserve le mieux l'utilité de la tâche.

Cette méthode surperforme les approches naïves de 37,2 % en termes de préservation de l'utilité. Comparée aux techniques de differential privacy (ajout de bruit statistique), qui n'atteignent qu'une efficacité de 42,8 %, la recherche arborescente offre une solution beaucoup plus robuste pour le prompting direct.

L'implémentation nécessite cependant des ressources computationnelles supplémentaires. Attendez-vous à une surcharge de 12 à 18 % par requête et une latence ajoutée moyenne de 320 à 450 millisecondes. Pour les applications temps réel critiques, ce délai doit être intégré dans la planification de l'architecture système.

Défis des Petits Modèles Open-Source

Si vous utilisez des modèles open-source inférieurs à 7 milliards de paramètres, vous rencontrerez des obstacles significatifs. Ces modèles sont 4,3 fois moins tolérants à la minimisation que les modèles frontiers de plus de 70 milliards de paramètres. Le modèle qwen2.5-0.5b, par exemple, n'atteint qu'un taux total de minimisation de 30,3 % contre 94,3 % pour GPT-4.

Pour contourner cette limitation, deux stratégies émergent :

- Fine-tuning LoRA : L'adaptation de rang faible (Low-Rank Adaptation) permet d'atteindre 68,9 % d'efficacité de minimisation avec une surcharge computationnelle réduite à 8-12 %.

- RAG : Les systèmes de Retrieval-Augmented Generation offrent 72,4 % d'efficacité mais nécessitent une infrastructure de base de données vectorielle supplémentaire.

Dr. Jane Chen, auteure principale de l'étude Carnegie Mellon, note que « la complexité architecturale des grands modèles crée une robustesse inhérente à la perte d'information, leur permettant d'inférer le contexte à partir d'indices minimaux ». Si vous êtes contraint d'utiliser de petits modèles, le fine-tuning spécialisé peut améliorer leur tolérance de 31,8 %, selon des recherches indépendantes de décembre 2024.

Outils et Intégration dans le Flux de Travail

L'intégration de la minimisation se fait en trois phases critiques. Premièrement, l'analyse pré-scan du prompt utilisant des outils DSPM (Data Security Posture Management) pour identifier les éléments sensibles. Deuxièmement, l'application des transformations REDACT ou ABSTRACT. Troisièmement, la validation de l'utilité pour s'assurer que la qualité de la réponse respecte le seuil requis.

Les outils DSPM combinés à un pré-scan des prompts peuvent réduire l'exposition des données sensibles de 83,7 %, selon Dr. Marcus Reed de Proofpoint. Cependant, Swati Popuri de Privacy Pointers met en garde contre les faux positifs, observant un taux de 18,3 % dans la détection automatique des PII. La courbe d'apprentissage pour les équipes de sécurité s'échelonne entre 8 et 12 semaines pour maîtriser ces techniques efficacement.

Impact Réglementaire et Conformité

La pression réglementaire accélère l'adoption de ces pratiques. Les actions d'exécution du RGPD liées aux pratiques de données des LLM ont augmenté de 214 % en 2024 par rapport à 2023. Dans le secteur de la santé, Michael Torres, CTO de HealthTech Solutions, rapporte avoir passé de 62 % à 100 % de réussite aux audits HIPAA après l'implémentation d'une DLP multicouche avec pré-scan et redaction des sorties.

Gartner prédit que 70 % des entreprises mettront en place des protocoles formels de minimisation des données LLM d'ici 2026. Le marché mondial des outils de minimisation atteint déjà 2,78 milliards de dollars au troisième trimestre 2024, avec une croissance annuelle de 38,7 %. Les secteurs de la santé (58,7 % d'adoption) et des services financiers (52,3 %) mènent cette transition en raison de leurs obligations strictes.

Quelle est la différence entre REDACT et ABSTRACT dans la minimisation des données ?

REDACT supprime complètement les informations sensibles du prompt, tandis que ABSTRACT remplace les détails spécifiques par des termes génériques pour préserver le contexte sans révéler d'identifiants uniques. Par exemple, ABSTRACT transforme « Jean Dupont » en « un client », alors que REDACT supprimerait le nom entièrement.

Les petits modèles open-source supportent-ils bien la minimisation des données ?

Non, les modèles inférieurs à 7 milliards de paramètres sont 4,3 fois moins tolérants à la minimisation que les grands modèles. Ils nécessitent souvent une conservation de près de 70 % des données pour maintenir l'utilité, contrairement aux modèles frontiers qui peuvent fonctionner avec seulement 5,7 % de données conservées.

Quel est l'impact sur la latence lors de l'utilisation de la minimisation des données ?

L'implémentation ajoute une latence moyenne de 320 à 450 millisecondes par requête et une surcharge computationnelle de 12 à 18 %. Ce délai provient du processus d'analyse pré-scan et de la recherche arborescente pour optimiser les transformations avant l'envoi au modèle.

Comment valider que la minimisation n'a pas dégradé la qualité de la réponse ?

Il faut utiliser un seuil de préservation d'utilité, généralement fixé à 85 % selon les recherches de Carnegie Mellon. Des oracles de minimisation dynamiques peuvent évaluer automatiquement si la réponse transformée répond toujours aux critères de performance attendus pour la tâche spécifique.

Quels outils recommandez-vous pour commencer la minimisation des données LLM ?

Les outils DSPM comme ceux de Proofpoint ou Laminar sont efficaces pour le pré-scan. Pour les développeurs, le toolkit open-source MinimizeLLM de PrivacyPointers offre une bonne base. Il est crucial de combiner ces outils avec une validation manuelle initiale pour ajuster les seuils de faux positifs.