Vous avez déjà ressenti cette frustration ? Vous demandez à une IA de résumer un rapport technique de 500 pages, mais elle oublie les détails cruciaux situés au milieu du document. Ou pire, elle hallucine des informations qui n'existent pas parce qu'elle a atteint la limite de sa « mémoire » immédiate. Pendant longtemps, c'était le prix à payer pour utiliser des modèles d'intelligence artificielle. Mais en 2026, cette barrière s'effondre. Nous ne sommes plus dans l'ère du prompt unique ; nous sommes entrés dans l'ère du contexte.

Le paysage de l'IA générative à long contexte, une architecture permettant aux modèles de maintenir et d'utiliser une mémoire contextuelle étendue bien au-delà des limites traditionnelles de tokens, activant un état persistant à travers les interactions change radicalement la donne. Il ne s'agit plus seulement de traiter plus de texte, mais de comprendre comment ces systèmes se souviennent, oublient et conservent un état cohérent sur de longues périodes. C'est ce qui transformera vos assistants numériques de simples outils de réponse en véritables partenaires capables de gérer des projets complexes sur plusieurs mois.

La Fin du Mur du Contexte : Pourquoi 2026 est une Année Pivot

Pour comprendre l'ampleur du changement, il faut regarder en arrière. Depuis la publication de « Attention Is All You Need » par Vaswani et al. en 2017, les transformers ont dominé le domaine. Leur force était leur capacité à prêter attention à chaque mot d'une phrase simultanément. Mais cette méthode avait un défaut majeur : le coût computationnel augmentait de façon linéaire avec la longueur du contexte. Si vous doublez la taille du document, le temps de traitement explose. NVIDIA a illustré ce problème en février 2026 : traiter le millionième token prenait jusqu'à un million de fois plus longtemps que le dixième token. C'était mathématiquement impraticable pour des documents massifs.

Ce que nous voyons aujourd'hui, c'est une rupture technologique. Selon les chercheurs de NVIDIA, Wei Deng, Ruosong Wang et Simon Shaolei Du, la communauté de recherche arrive enfin à une solution de base pour le contexte long en 2026. Plus besoin de choisir entre vitesse et précision. Les nouvelles architectures permettent désormais de traiter des millions de tokens sans que la latence n'explose ni la qualité de la réponse ne chute. L'infrastructure suit aussi : WEKA, spécialisée dans le stockage haute performance, a déclaré que l'inférence n'avait pas rencontré un mur de calcul, mais un mur de mémoire contextuelle. Le nouveau KPI critique n'est plus la puissance brute du processeur, mais le « débit contextuel ».

Les Deux Approches Dominantes : Compression vs Mémoire Séléctive

Comment font-ils cela ? Deux approches majeures émergent, chacune avec sa philosophie propre. D'un côté, nous avons TTT-E2E (Test-Time Training End-to-End) de NVIDIA. De l'autre, l'architecture Titans + MIRAS de Google Research.

NVIDIA a pris une approche audacieuse avec TTT-E2E. Au lieu de simplement lire le contexte, le modèle le traite comme des données d'entraînement pendant l'inférence. Imaginez que vous lisiez un livre et que, tout en avançant, vous condensiez mentalement les chapitres précédents pour libérer de l'espace mental, sans perdre l'essentiel. Cette compression contextuelle permet une latence constante, quelle que soit la longueur du texte. Sur les GPU H100 de NVIDIA, TTT-E2E est 2,7 fois plus rapide que l'attention complète pour un contexte de 128K tokens, et 35 fois plus rapide pour 2 millions de tokens. C'est une victoire majeure pour la vitesse.

Google, avec Titans, joue la carte de la sélectivité intelligente. Leur système utilise un module de mémoire à long terme neuronal, implémenté sous forme de perceptron multicouche (MLP) plutôt que de vecteurs de taille fixe comme dans les anciens réseaux neuronaux récurrents (RNN). Le secret ? Un mécanisme de « surprise ». Si le modèle s'attend à voir un mot lié aux animaux dans un paragraphe sur la faune, ce mot est peu « surprenant » et reçoit une faible priorité de stockage. En revanche, si une image de peau de banane apparaît soudainement dans un rapport financier, c'est hautement surprenant. Le modèle déclenche alors un stockage permanent dans la mémoire à long terme. Cela permet à Titans de surpasser des modèles beaucoup plus grands, comme GPT-4, sur le benchmark BABILong pour le raisonnement sur des documents extrêmement longs.

| Caractéristique | NVIDIA TTT-E2E | Google Titans + MIRAS | Transformers Classiques (GPT-style) |

|---|---|---|---|

| Mécanisme Principal | Compression par entraînement en temps réel | Mémoire neuronale basée sur la « surprise » | Attention complète (Full Attention) |

| Latence (Vitesse) | Constante, très rapide | Efficace, variable selon la complexité | Explosive (O(n²) ou O(n)) |

| Précision du Récupération | d>Élevée, perte minimale | Très élevée pour les faits clés | Parfaite pour petits contextes, dégradée pour grands |

| Limite Pratique Actuelle | Jusqu'à 2M+ tokens testés | > 2M tokens | Généralement limité à 128K-200K |

| Bias Connu | Minimal grâce à la compression continue | Sensible au calibrage du seuil de surprise | Fort biais début-fin (oubli du milieu) |

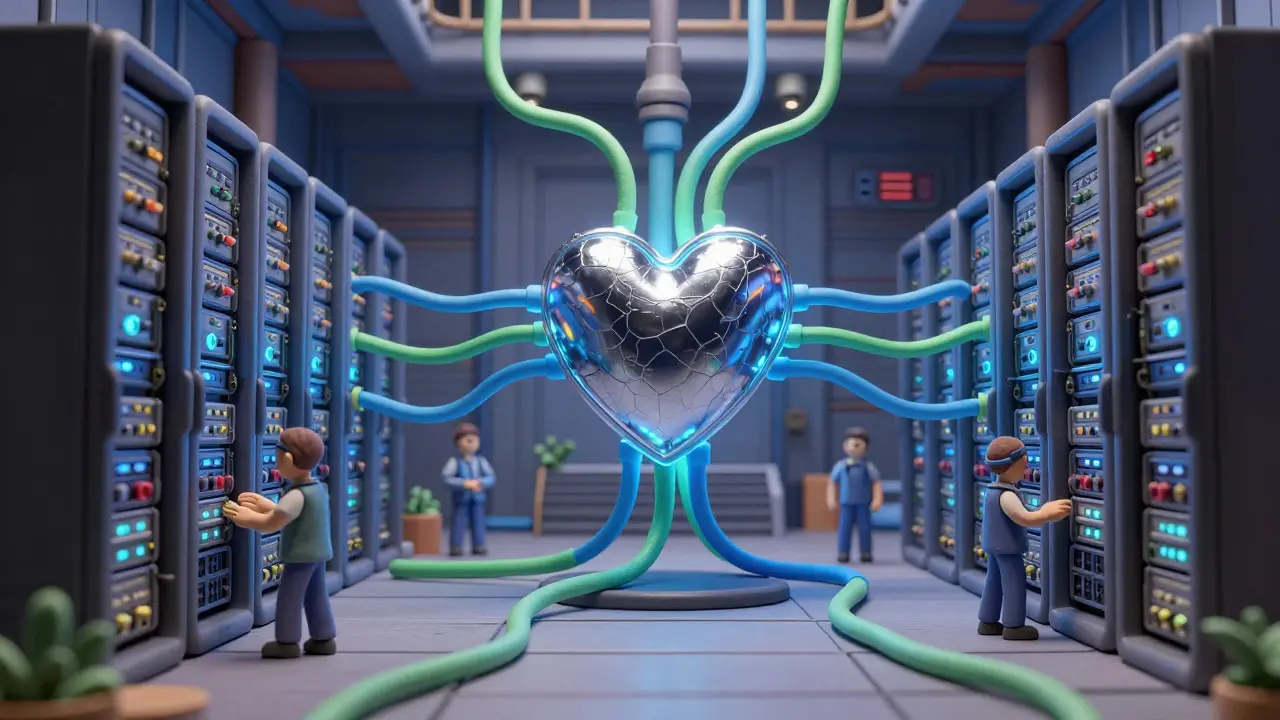

L'Infrastructure Matérielle : Le Nouveau Goulot d'Étranglement

Avoir un bon algorithme ne suffit pas si votre matériel ne peut pas suivre. L'adoption du contexte long impose de nouvelles exigences hardware. Lors du CES 2026, NVIDIA a dévoilé sa plateforme de stockage de mémoire contextuelle d'inférence, propulsée par les processeurs de données BlueField-4. L'idée est de traiter le contexte comme une ressource de premier ordre, pas juste comme des données temporaires.

Cela signifie des connexions RDMA (Remote Direct Memory Access), des fabrics backed par NVMe et l'utilisation de NVIDIA GPUDirect Storage pour étendre la capacité de mémoire des GPU. WEKA, avec son Augmented Memory Grid, a reçu une note de 4,7/5 auprès des entreprises précisément pour sa mise en œuvre d'un cache KV (Key-Value) persistant et réutilisable. Pour les développeurs, cela implique que la gestion de la mémoire distribuée devient une compétence critique. Sphere Partners note dans son guide IA de février 2026 que l'architecture « contexte-first » (préparation des données, graphes de connaissances, RAG, gouvernance) est ce qui transformera les pilotes expérimentaux en valeur production en 2026-2027.

Défis Réels : Biais Début-Fin et Calibration

Tout n'est pas rose. Malgré les progrès, des problèmes persistent. VirtusLab a documenté le phénomène de « biais début-fin » le 3 février 2026. Même avec des fenêtres de contexte étendues, les LLMs ont tendance à mieux se souvenir du début et de la fin d'un document, laissant tomber les détails du milieu. C'est un problème sérieux pour les contrats juridiques ou les rapports techniques où la nuance centrale est souvent la plus importante. Un utilisateur Reddit, « DataArchitectPro », a signalé que ce biais causait des omissions dans des documents techniques de 200K tokens.

De plus, le calibrage des nouveaux mécanismes demande du temps. Pour Google Titans, ajuster le seuil de « surprise » prend 15 à 20 % du temps d'implémentation. Si le seuil est trop bas, le modèle stocke du bruit inutilement. S'il est trop haut, il rate des informations critiques. NVIDIA prévient également que les tendances d'échelle doivent être validées continuellement au-delà de 2 millions de tokens. La course est lancée, mais la stabilité reste un travail en cours.

Adoption Entreprises : Vers l'IA Agente Persistante

Qui utilise tout ça ? Les secteurs juridique et médical sont en tête, avec respectivement 78 % et 65 % d'adoption pour les applications à contexte long, selon Clarifai. Pourquoi ? Parce que ces domaines génèrent des volumes massifs de documents interconnectés où la mémoire à court terme est insuffisante. Un avocat ne veut pas re-contextualiser un dossier de 10 ans à chaque nouvelle question.

L'enjeu ultime est l'IA agente. Pour qu'un agent IA fonctionne de manière autonome sur de longues périodes, il doit avoir un état persistant. Des solutions comme Hindsight, A-MEM, GAM (General Agentic Memory), LangMem et Memobase gagnent en traction depuis le quatrième trimestre 2025. Elles spécialisent le rappel à long terme sur des mois d'opérations, pas juste sur une session unique. Okoone rapporte que 67 % des organisations prioritaires maintenant les « capacités de mémoire à contexte long » lors du choix de leurs plateformes IA, contre seulement 22 % au troisième trimestre 2025. Le marché de l'IA entreprise devrait atteindre 1,2 billion de dollars en 2026, dont 23 % dédié à l'infrastructure de gestion du contexte.

Que Faire en Tant Que Développeur ou Décideur ?

Si vous construisez des applications IA, arrêtez de penser en termes de prompts isolés. Commencez à concevoir des systèmes avec une mémoire explicite. Voici quelques étapes concrètes :

- Évaluez vos besoins de rétention : Avez-vous besoin de rappeler un fait précis après 10 000 tokens (Titans excelle ici) ou de traiter un flux continu de données en temps réel (TTT-E2E est idéal) ?

- Investissez dans l'infrastructure de cache : Ne laissez pas votre application reconstruire le contexte à zéro à chaque requête. Utilisez des solutions comme WEKA ou Redis optimisées pour le cache KV.

- Formez vos équipes : Comptez 3 à 6 semaines pour que vos ingénieurs ML maîtrisent ces architectures optimisées. Apprenez-leur à gérer le cycle de vie du contexte, pas juste l'ingénierie des prompts.

- Surveillez les biais : Mettez en place des tests spécifiques pour vérifier si votre modèle néglige le milieu de vos documents longs. Corrigez le tir en structurant vos données d'entrée pour mitiger ce biais.

La trajectoire est claire. Forrester prédit que les fenêtres de contexte dépasseront 10 millions de tokens d'ici 2027. L'IA ne sera plus seulement réactive ; elle sera mémorielle. Ceux qui sauront exploiter cette mémoire persistante construiront les agents autonomes de demain.

Quelle est la différence principale entre TTT-E2E de NVIDIA et Titans de Google ?

TTT-E2E se concentre sur la compression contextuelle en traitant l'entrée comme des données d'entraînement pendant l'inférence, offrant une latence constante et très rapide. Titans, quant à lui, utilise une mémoire neuronale à long terme basée sur un mécanisme de « surprise » pour stocker sélectivement les informations importantes, privilégiant la précision du raisonnement sur des documents extrêmement longs.

Qu'est-ce que le « biais début-fin » dans les modèles à long contexte ?

C'est un phénomène où les modèles de langage ont tendance à mieux se souvenir et à récupérer les informations situées au début et à la fin d'un document très long, tout en ayant des difficultés à accéder aux détails présents dans la partie centrale. Cela peut entraîner des erreurs ou des omissions dans l'analyse de documents complexes.

Pourquoi l'infrastructure matérielle est-elle critique pour le contexte long en 2026 ?

Le goulot d'étranglement n'est plus seulement le calcul, mais la mémoire. Les nouveaux modèles nécessitent des accès rapides à de grandes quantités de données contextuelles. Des technologies comme les processeurs BlueField-4 de NVIDIA et les fabrics NVMe de WEKA sont nécessaires pour éviter les blocages GPU et permettre un partage efficace du cache KV (Key-Value).

Quels secteurs adoptent le plus rapidement les IA à contexte long ?

Le secteur juridique (78 %) et le secteur de la santé (65 %) sont en tête. Ces industries traitent naturellement de vastes volumes de documents interconnectés et nécessitent une précision et une mémoire à long terme que les modèles à contexte court ne peuvent pas fournir.

Quand pouvons-nous nous attendre à des fenêtres de contexte dépassant 10 millions de tokens ?

Selon les analyses de Forrester publiées en janvier 2026, les fenêtres de contexte devraient dépasser 10 millions de tokens d'ici 2027, avec une intégration croissante des modèles à mémoire augmentée dans les applications entreprises standard.

Comment les entreprises gèrent-elles la mémoire à long terme au-delà d'une seule session ?

Elles utilisent des solutions spécialisées comme Hindsight, A-MEM, GAM, LangMem et Memobase. Ces outils permettent de maintenir un état persistant et de récupérer des informations sur des mois d'opérations, essentiel pour le développement d'agents IA autonomes.